人類長期的進化,形成了針對真實世界的感知神經系統。

最近元宇宙非常火,我先在網上看到了網友們PO的Quest2體驗視頻,感覺有點意思。正巧有機會可以親身體驗Quest2,趕緊安排上。 Quest2拿到手後,發現近視竟然啥也看不清。只得網上配了個磁吸鏡片,配置好了網絡和賬號後,總算進來了。

大家隨手一搜,都能找到不少很多關於Quest2的體驗、WorkRoom的辦公應用演示等等視頻。這些體驗大多是站在終端用戶的角度來看待這款產品,很專業,也有很高的參考價值。這裡就不重複介紹了。強烈建議大家看看這個體驗視頻(https://www.bilibili.com/video/BV15M4y1G7fJ)。

接下來我想介紹的是一些稍有差異的思考和想法。

VR形態分類

一般VR從形態上看主要有三種類型,Quest2屬於第三種。

我個人感覺第一種移動端頭顯和第三種一體機頭顯都是擺脫了傳統VR依賴PC算力,具有比較強的獨立性和便攜性。

第一種類型移動端頭顯,其實可以理解成第三種類型一體機頭顯的可拆卸存在:眼鏡盒子+手機=移動端頭顯。可以設想一下,當眼鏡盒子提供了輸入接口,提供了屏幕顯示方案,並且解決了可視區視野問題和頭戴舒適型問題(iPhone手機大概200g,Quest2大概500g);同時利用手機作為算力中心,這種情況下單個盒子的價格是有可能做的比第三種類型一體機頭顯低的。而且如果手機和頭顯基於無線來傳輸數據,單個盒子重量也會比第三種一體機輕。目前大家對第一種類型移動端頭顯印像很不好,主要還是由於被市場上200塊錢的山寨盒子給坑了。

體驗感受

虛擬世界對人體感知系統的兼容適配

人類長期的進化,形成了針對真實世界的感知神經系統。通過視覺,嗅覺,觸覺等感知渠道,持續性感知到內容(打個比方,這個是就像視頻流裡的一幀frame)。大腦有認知模型,會對他有形成一系列的判斷輸出(detect識別結果),然後調整自己的心里和身體狀態(身體條件反應action)。

• 渲染出來的虛擬世界,如果不合理,或者不尋常,大腦花費在識別的能耗就會飆升。

比如說我們看到了一些真實世界略微相背的邏輯:看到的沉浸式圖像不怎麼清晰,人就會覺得有異樣;或者在一個空間裡,有一些東西由於風向左傾斜,有一些東西看起來卻是像右邊。這些看起來違背了之前的對真實世界規律的情況,會耗費大量的人腦算力進行判斷。

• 連續的圖片流,每一幀產生的人體認知或者判斷是相背,人腦對同一個事物的判斷,不斷地在切換狀態。反反复复的back and forth不自覺地讓腦子一直在高頻的識別:確認,懷疑,再識別,再確認,再懷疑的狀態裡。

人長期進化出來的生理反應,基於大腦的當前判斷去調整自己的神經反應。這套人腦和神經系統是適配了真實世界的規律,如果構造出來的虛擬世界運行規律和真實世界規律相差太大,直接的體現就是眩暈,累。那要么就是人體經過磨合慢慢適應了這套虛擬世界規律,要么就是構造逼真的虛擬世界來降低眩暈感。總得來說,生理結構的進化是長期演變的過程,而後者虛擬環境要怎麼樣更加逼真,我們後邊還會談到。

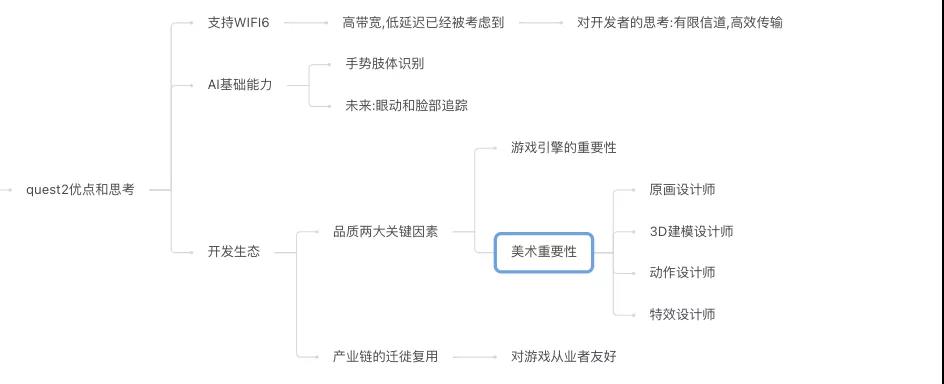

支持WIFI6

高帶寬,低延遲已經被考慮到。現實網絡中任何一個節點都可能成為瓶頸。回顧歷史,從飛鴿傳書,到電報到實時語音,我們可以理解是對現場的原始信息進行了摘要,再通過一根管道傳輸到另一端。作為末端的用戶,要感知到原始端的全量信息是不可能,更別說無延時。我們的遠程視頻通話(二維圖像傳輸),很多時候明顯感覺有時延。而在技術層面上,通過降低圖像分辨率、幀率等來減少信息量。

如果在VR裡,將當前三維空間的整體信息傳輸到遠端,體驗上肯定是災難。所以我們看到Quest2裡一些應用設計技巧,比如Horizon Workrooms裡,假如有另一個小伙伴在裡邊,他並不是實時來傳輸這個小伙伴的3D模型,而是預先下載了對應的模型,傳輸了FaceMesh以及姿態信息等控制模型。高效利用有限的信道非常關鍵。這也是為什麼現在你看到的Quest2開遠程會議,最多只能16個人。人太多,一方面除了端上渲染跟不上(這個問題我們後面再說),還有就是數據傳不來啊。

加強AI能力

我們看到Quest2已經有了一些手勢和肢體識別等。在接下來的硬件產品,眼動追踪和麵部追踪也會被加入,能在很大程度上改變目前的“虛擬角色”活動體驗。用戶彼此之間不但能看到對方的高仿真角色,甚至還能進行微表情交流。前面提到的這幾項AI能力,在現有互聯網裡,應用起來還是比較弱的。但是在虛擬角色為主的VR世界裡,重要性會提升幾個level。

Quest 和 Quest2 都使用固定注視點渲染。 這意味著它會嘗試以更高的分辨率渲染您正在查看的圖像部分,同時以較低的分辨率渲染周邊視覺中的內容以節省資源。 由於 Quest/2 沒有眼動追踪,因此它必須假設您始終注視屏幕中心來近似您正在看的位置。

有眼球追踪,可以更高效渲染,有重點地去渲染。

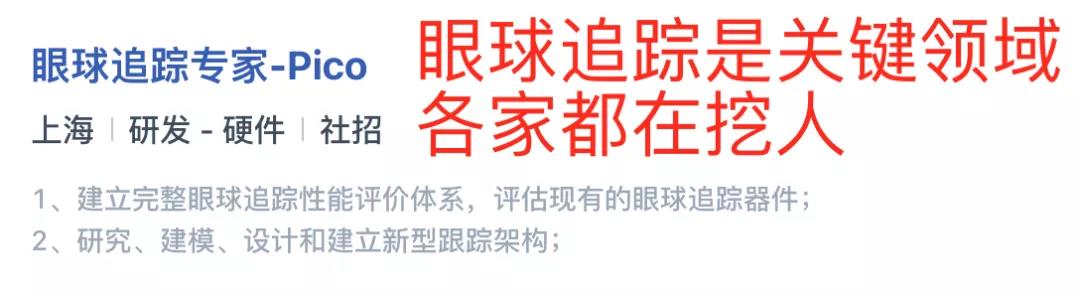

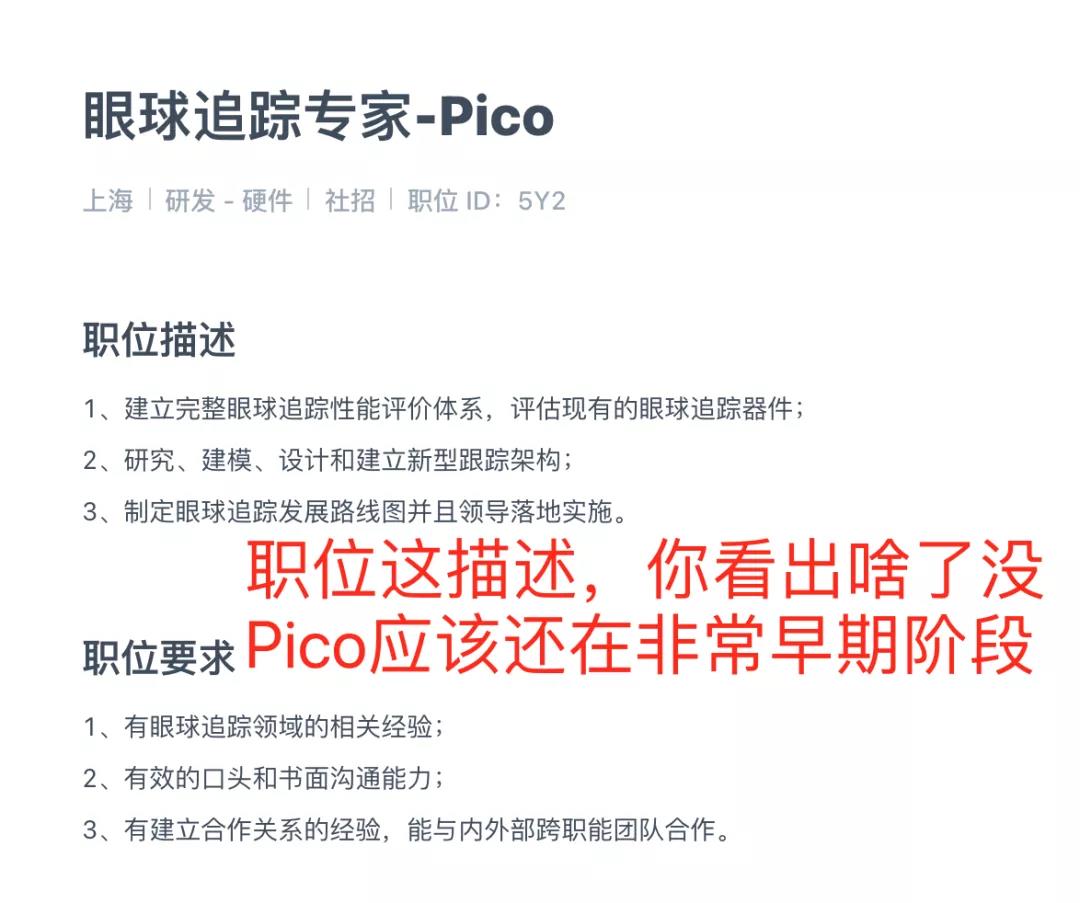

要理解一下公司接下來要幹啥,一種途徑就是就去看他招聘什麼樣的人才。那我們去看看頭條天價收購的Pico都在招什麼人參考一下。第一個職位是眼球追踪專家。

Quest2下個版本應該能上眼球追踪,Pico看來還早。

開發生態

VR類的APP和傳統的APP開發還是有差異,傳統功能性APP比如你用的微信美團等APP更多的是2D開發,基於系統提供SDK對UI控件進行UI呈現,實現業務邏輯和調用硬件能力。

但是VR是3D 世界,徒手基於VR設備提供的SDK也可以搞。但是置現代工具而不用,這幾乎就是刀耕火種,累死開發。在競爭對手面前,近乎秒殺成炮灰。

在這裡我們簡單介紹一下游戲引擎和渲染引擎。對這倆概念簡單了解後,你會發現作為VR的開發會更依賴這些引擎。

-

渲染引擎:

DirectX(視窗)

OpenGL(開源)

金屬(iOS)

-

遊戲引擎:

UE4, Unity3D等跨平台

DirectX和OpenGL是圖形渲染的API,通過這套API應用層可以控制GPU進行圖形的繪製渲染。其中DirectX是微軟開發的,只能跑在Windows上面,而OpenGL是一個國際標準,可以跨平台;

而UE4和Unity3D是遊戲引擎,除了集合DirectX和OpenGL進行圖形渲染之後,還包括了遊戲所需要的其他元素,包括:物理引擎,語音模塊,網絡通信,輸入輸出模塊等等,相對DirectX和OpenGL要復雜龐大很多。

這裡舉一個例子,假如你開發了一款APP跑在Quest2裡,或者其他VR設備,針對下面這個場景:

有一個人手裡拿著一個石頭,坐在沙河西邊上,使勁往左前方河里扔了個石頭,水花四濺,同時從左前方落水點傳回了聲音。

可以看到,要開發這樣的一個場景,可就不僅僅是用OpenGL這樣的渲染引擎就夠了。還要根據力度計算拋物線軌跡,水花的濺射效果,合理設置聲音的強弱和方向。這個時候沒有遊戲引擎,基本上就無法搞下去。由此可見,遊戲引擎在3D世界裡開發的重要性。

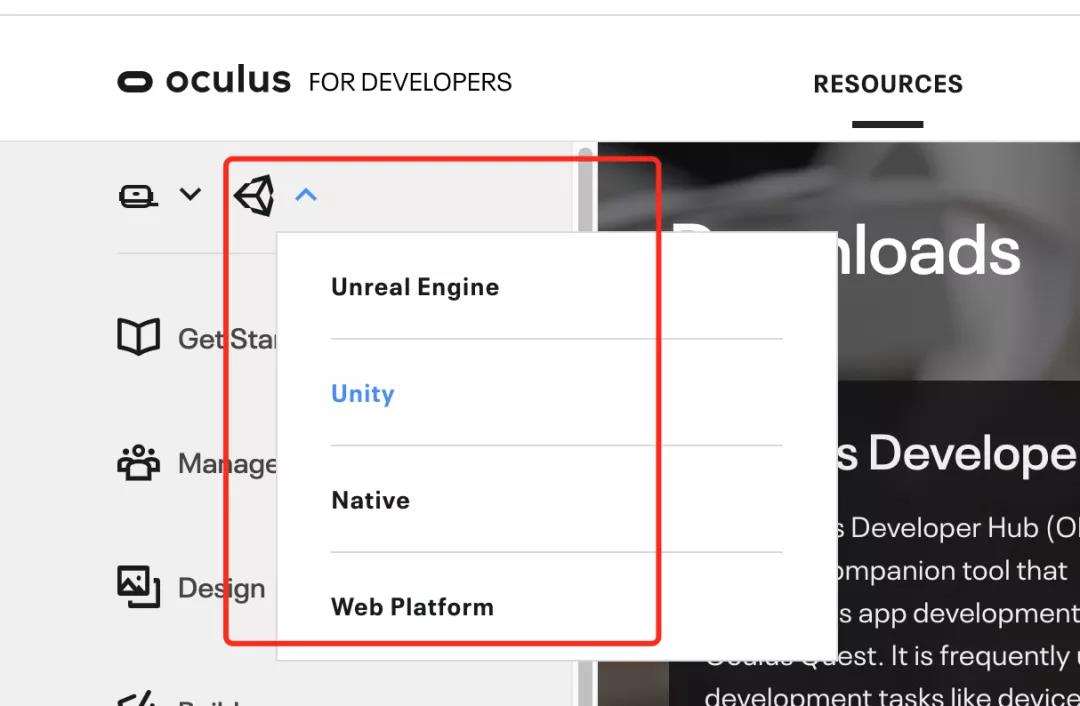

我們上去Pico開發者平台和Quest2開發平台看一下,都離不開遊戲引擎。

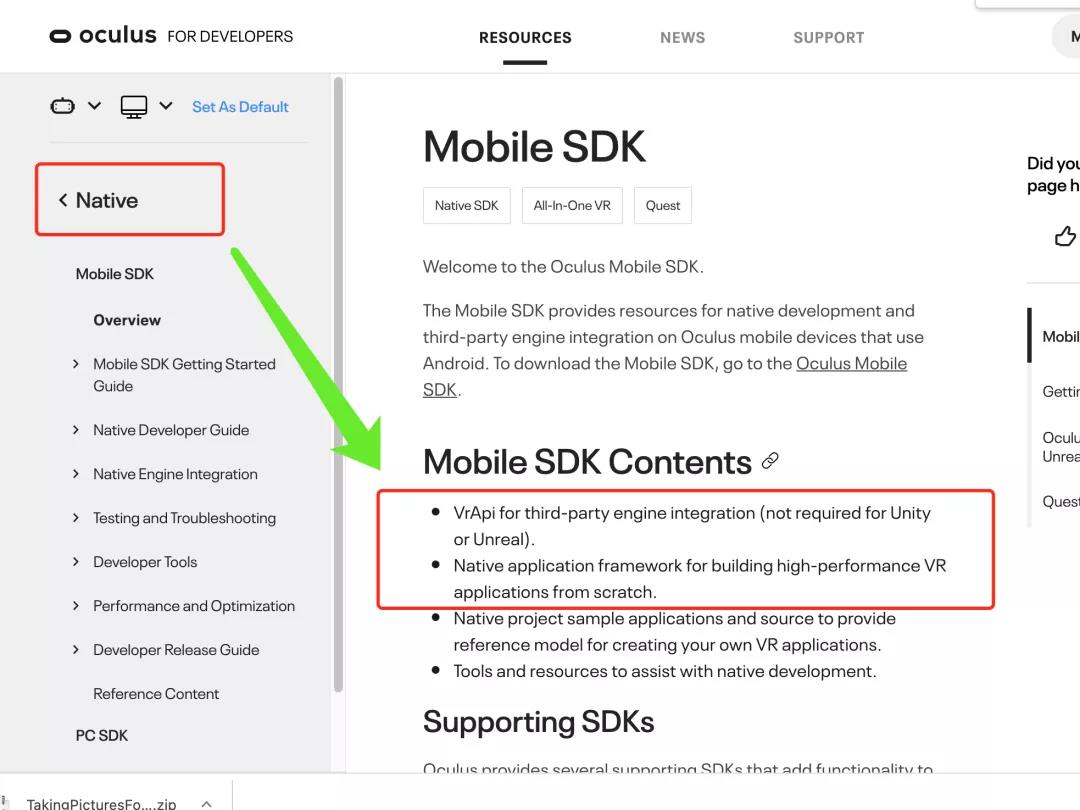

不基於引擎,用Native,文檔裡第一條,人家主要是為這倆大主流引擎之外的遊戲引擎提供接入的可能。相當於說,我們專門為主流的U3D和Unreal適配了倆個SDK,其他的你就要這種方式來集成兼容。

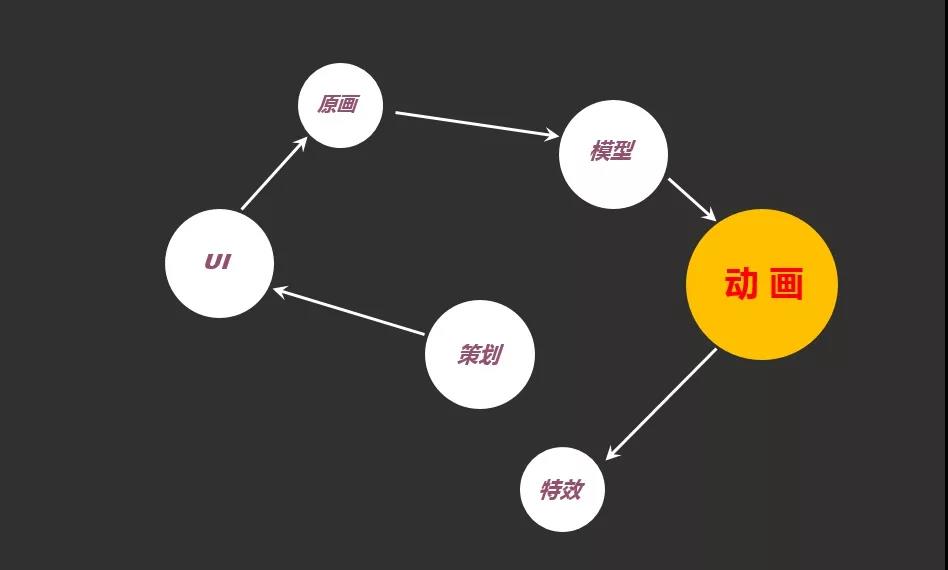

影響遊戲品質的另一個主要因素是美術。從流程上看,包括了原畫、模型、動畫、特效,這些都需要有對應的美術角色人員。

-

原畫設計是指在動畫片創作中,一種場景動作的開始和結束的畫面,按線稿的方式繪製在紙上。換言之,原畫是指指物體運動過程中的關鍵動作。在計算機設計中也稱“關鍵幀”,原畫是相對於動畫的。

-

3D角色美術設計師則根據角色原畫設計師的構思,將二維的東西在3d軟件裡面製作出來,最終得到的東西是模型(3Dmax)和貼圖(軟件PS、bodypaint),模型是物體的主要構架,貼圖是構架上的顏色和式樣。

-

接下來負責動畫的同學就需要對角色進行骨骼的架設,讓角色能按照我們的想法去動,那就得匹配上跟真實世界一樣的骨骼,這樣才方便我們對這個虛擬人物進行各種造型的擺佈,這個過程就是角色骨骼綁定。當然現在也有一些動作捕捉的技術,可以理解是動作行業的一個技術發展。

-

最後為了增加參與度和互動感,就需要增加對應的特效,比如火焰等等。

可以看到我上面舉例很多都是遊戲人物,但是其實作為場景3D設計也是一樣的。對從業人員,他們需要的技能也是相似。

所以VR整體的開發,對於專業3D遊戲開發者來說比較友好。整個產業鏈可以遷徙復用,開發者、設計師等角色沒有多大變化。先不考慮用戶和遊戲的交互,一款3D遊戲,開發者一開始就是在三維空間使用立體模型等來構造三維世界。由於屏幕是二維,將三維投影降維成二維顯示。而最核心的是三維世界的構造。所以我們看到很多3D遊戲經過快速適配後,可以在Quest2裡跑起來。而在遊戲開發者工具集上,開發者是可以復用現有的工具,核心依然是使用UE4或者Unity 等遊戲引擎。設計師用Blender,MAYA,CINEMA 4D等來構建3D模型資源。對於一些2D素材以及紋理則用ps,GIMP等工具。最後生成一個Android安裝包跑在Android系統裡。但是這一整套開發又和傳統的Android手機應用開發是不一樣的,如果基於Unity更多的是C#相關的代碼。

Quest2不佳的體驗點和提升空間

暈眩感

正如前面說的一樣,眩暈感是VR設備好壞的衡量標準。個人認為是有如下幾個地方是值得關注的:

-

設備處理能力

分辨率、刷新幀率、運算能力。 quest2目前還是固定幀率刷新。可變幀率開始在手機端成為標配,能夠讓硬件性能更合理髮揮。像蘋果的可變幀率promotion暴露對應的接口,給開發者動態來選擇合適的幀率。在渲染任務重的時候,適當降低幀率還換取流暢性。目前來看,Facebook在做硬件上遠沒有蘋果沉澱多,這塊估計沒那麼快。

-

對開發者的挑戰提高

應用開發者:無論是APP自身的內存處理,UI細節,還是物理運動等都會對遊戲品質造成影響。而用戶在VR中的感受更加強烈。

系統開發者:一方面是系統層面,就像Android和iOS,大家都有感受。另外就是暴露出來給應用開發者的框架層,對於渲染引擎的優化,還有API友好程度等都有新的要求。我們看到即使蘋果自身沒有VR設備,但是還是一直在做這方面的技術升級和儲備。 OpenGL畢竟年代久遠,在新的芯片硬件上,怎麼樣合理去驅動硬件,就需要新的軟件驅動層。蘋果在2014年推出了Metal渲染引擎,這個過程一直在迭代。 2017年推出了VR with Metal 2,可見在底層也是在不斷打磨自己的技術基座。

-

高質量3D資源

3D模型資源是虛擬世界的基礎物料,虛擬世界的精細程度很大取決於模型的質量。

從業人員:這方面的從業人員或者專門做3D的設計師還是比較少,而這些設計師其實會很大程度上決定三維空間模型的數量。

模型生產工具:蘋果在3D模型上,這幾年也是動作不少。今年的Object Capture更是從製造3D資源的生產工具鏈著手,來提升生產3D資源的效率。

蘋果的Object Capture使用70多張多角度拍攝出來的二維圖片自動生成3D模型。

生成的模型效果:

續航能力

-

硬件層面

電池:毋庸置疑,容量上去了能更持久。

芯片:低功耗芯片也是一個關鍵因素,Quest2採用的是高通SnapdragonXR2處理器。對Facebook來說,自研芯片能力缺乏沉澱,屬於軟肋。

-

軟件層面

就像我們前面說優秀的os,開發框架和遊戲引擎能降低能耗。

網絡

因為APP的數據訪問需要觸達國外機房,國內數據中心才能提高更好的訪問速度。 FQ是問題,不過不是影響VR設備發展的核心因素。

遊戲內容豐富度

目前大部分的3D素材依賴設計師製作,而網上開源放出來的高質量素材是有限的,並沒有那麼多。

對於模型,是否會有更合適的開源機制的或者商用付費機制出來,也是值得期待。 NFT的誕生就為這些原來根本沒有辦法去物質化和客觀化的有價值的數字資產提供一種新的渠道。你可以把它們從一個遊戲或者應用帶到另一個應用,並且可以真正擁有它們。複製成本越來越低的世界,物質的稀缺性,也就是越少越值錢的邏輯,已經被這個注意力的稀缺性,越有名越值錢的邏輯所取代了。在虛擬世界了,應該很多人都希望有Tony老師設計的髮型模型,未來的優秀的3D設計師應該是炙手可熱。

我們看到很多遊戲,基本還是圍繞主線,沒有過多冗餘的內容能讓用戶體驗更輕鬆,沒那麼暈。與此同時,整個虛擬世界視野是更寬廣,在硬件和軟件渲染能力提高的情況下,隨著舒適度的提升,大家會趨於更複雜的場景和精細複雜的模型內容,那這大量開發工作,可能會催生新的製作模式。可能會有一些自動化生成機制。超大型應用要怎麼樣完善內容生態的自我構建和用戶參與內容的構建(例如Sandbox)可能是未來值得思考的地方。

最近一段時間,小道消息一直在報導Facebook將公佈公司的新名稱以反映其專注於構建“元宇宙”(metaverse)。 (一覺醒來,人家就改了)

當前手持設備系統基本被iOS,Android系統所霸占。 Quest2使用的是Android,為了讓產品能更好,軟硬層面去提升是必然要走的。正如前面提到的OS,渲染,芯片,AI能力,這一系列的基礎技術基座,拿到市面上看每一項看起來落後於別人,但是畢竟它整合造出來了。 Oculus Quest2 截至到2021年9月份出貨量在400萬台左右,同時隨著10月份熱度上升,身邊有好幾個朋友就是在10月份後才入手。今年非常有希望能到達900w-1000w台設備。

在量上,Facebook現在有非常好的先發優勢。硬件入口是基礎設施,搭載高度適配了硬件的OS,提供友好的開發工具和框架來擁抱開發者。這一群人在這個生態裡創造了內容,吸引到普通的消費者,多麼熟悉的蘋果套路。 Facebook在這條路上還有很長的距離要走(當年的HTC在智能手機上起了個大早,最終趕了個晚集)。市場的真正競爭對手,背地裡也正在集齊七龍珠,有一些還集齊了好幾個了。

作者簡介

adamschen(陳潔丹)

基礎科技產品部/終端開發室/室副經理

展開全文打開碳鏈價值APP 查看更多精彩資訊