簡述

近期“AI+Web3”的熱度上升,相關概念Token 也迎來了一波漲幅,由於很多加密圈的朋友並不是非常了解AIGC,這可能會導致投資失誤或者錯過潛在的機會。我從去年1 月份開始關注AIGC,親身經歷了2022 年AIGC 技術和產業的高速發展,今天我就跟大家簡單解讀一下現在AIGC 的發展格局、AI+Web3 項目的現狀以及如何使用AIGC 工具創作Web3 資產。

AIGC

AI 模型分類

從模型功能上區分,目前AIGC 主要涉及文字、圖片、音樂和視頻的生成(本文主要分析AIGC即人工智能生成內容領域,暫不涉及其他AI分支)。

文字

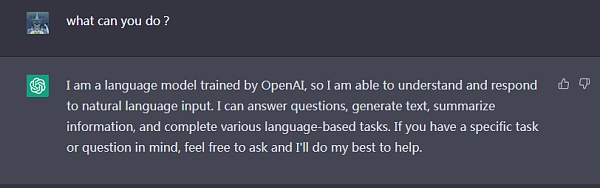

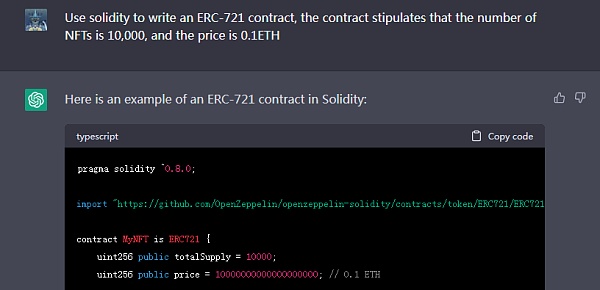

文字模型現象級應用當屬OpenAI 的ChatGPT,續寫文字、創作故事、寫代碼、修BUG、寫詩、做表…… 你所有能想像到的與文字相關的內容它都可以做。它可以極大程度上減少人的工作量,使用得當將會是文字工作者的利器。現在媒體平台上很多文章都是用AI 寫的,這一領域有很多潛在的機會,解決實際問題,創造新的工作流,打造商業閉環是我們這些使用工具的人需要去考慮的事情。

ChatGPT 可以幫助開發人員完成大量的代碼編寫工作,還可以查找修改錯誤,當然它有可能出錯,在使用中需要留意,盡信書不如無書。

此外,各類建議、策劃、編撰等文字工作是它最擅長的,對於文字工作者來說,ChatGPT絕對是超強的輔助工具。

但是ChatGPT 不是萬能的,你可以將其定義為一個什麼都懂一些的“全才”,但它卻不是精通一切的“專家”。對於某些比較專業的知識,它的回答可能會出錯,這包括但不限於編程細節、密碼學、數學、歷史等領域,所以在使用ChatGPT 的時候最好對內容再复核一遍,以免出現嚴重錯誤,在最近的版本更新中,ChatGPT 很多錯誤點已經得到了修正,隨著模型的逐步完善,未來的想像力是無限的。

圖片

AI 生成圖片是AIGC 領域發展最快的賽道,2021 年最火的技術還是生成對抗網絡(GAN),但是它距離產品化還有很長的距離;到了2022 年初,Disco Diffusion 橫空出世引發了第一波AIGC 爆點,Disco Diffusion 擅長對場景的刻畫,出圖場面恢弘大氣,但是畫面不夠清晰,作圖速度慢,要以10分鐘計數;4月份,OpenAI 的DALLE 2 上線,7月份Midjourney 開放公測,使用Discord 端作畫,1 分鐘之內可以同時出4 張圖,藝術性超高,在11 月份發布V4 版本後進一步穩固了自己最強AI 作畫工具的地位;8 月份,Stable Diffusion 正式發布,作圖速度縮短至10 秒之內,圖片細節、清晰度都有極大的提升,並且奉行開源主義,所有代碼都開源,這也誕生了龐大的社區,是之後世界範圍內AIGC 流行的火種,包括後面基於Stable Diffusion 訓練的專門生成二次元圖像的NovalAI。

如今AI 作圖領域呈現Midjourney + Stable Diffusion 的雙巨頭局勢,Disco Diffusion 和DALLE2 在技術更新上已經離開了第一梯隊,其餘產品大多都是基於Stable Diffusion 的開源框架調整的。

音樂&視頻

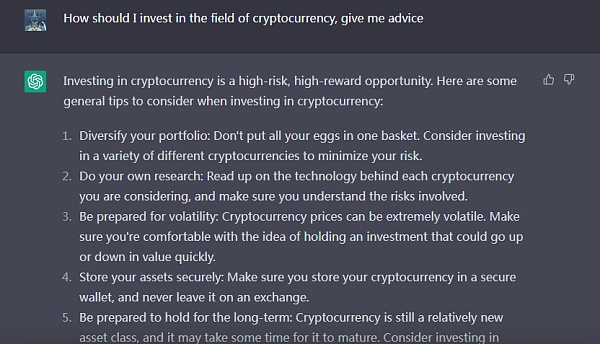

AI 生成音樂和視頻是一個發展相對較慢的賽道,至今還沒有現象級應用,市場上存在的產品均不太成熟,其在技術難度上比生成圖片和文字要大,但是已經有很多公司準備在2023 年攻克這個難題,或許我們馬上就能看到比較成熟的視頻和音樂生成平台。下面我挑選幾個相對優秀的產品簡單介紹一下。

AI 生成音樂最常見的玩法是用戶輸入一段文字或者一張圖片,模型根據內容輸出一段音樂,對應的產品可以關注Riffusion,它除了實現以上功能外還能在不同風格輸入之間自然轉換。

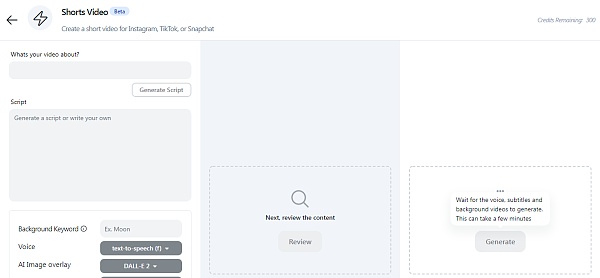

AI生成視頻可以體驗產品QuickVid,它可以在很短的時間內根據文字描述生成一段流暢的視頻,你還可以選擇不同使用場景下的視頻風格,視頻質量較高,與人為剪輯的效果差別不大。

AIGC+Web3 玩法

AIGC 可以助力Web3 項目更快更好的完成文字和圖片的設計工作,這在NFT 和GameFi 項目中應用最為廣泛,但是這也需要一定的技巧,使用恰當的Prompt 使AIGC 輸出可用的圖片,並使用ChatGPT 完成項目文案相關工作,描述詞的使用有很多講究,成為一名AI藝術家需要很多的前期學習,為了讓大家快速完成需求,下面我簡單說幾種使用AIGC 輸出Web3 可用圖像的方法。

特殊Prompt

有一些特殊的Prompt 可以控制模型輸出特定風格的圖片,這些圖片可以直接拿來作為NFT或者GameFi 內素材使用,版權屬於創作者自己。下面我使用Stable Diffusion 做一些示範(stable diffusion 開源免費試用,每個人都可以嘗試)。直接複製我下面的描述詞,自己定義括號中的內容。

塑料雕像

注:只需要改變括號中的內容就可以得到相同類型的圖片,示例文字順序=圖片順序,圖片內角色依次為Yoda、Superman、ironMan、MaiShiranui、shark、batman、Bumblebee和wizard。你可以嘗試所有其他可能性。

Funky pop (Yoda/Superman/iron Man/Mai Shiranui/shark/batman/Bumblebee/wizard) figurine, made of plastic, product studio shot, on a white background, diffused lighting, centered

這類圖片直接發一個NFT 項目綽綽有餘,每個都是1/1,你只需要告訴AI 想要什麼。

模塊建築

這段描述詞中的temple 可以改也可以不改,都可以做出不錯的效果圖。

Tiny cute isometric temple, soft smooth lighting, soft colors, soft colors, 100mm lens, 3d blender render, trending on polycount, modular constructivism, blue blackground, physically based rendering, centered

這類圖片可以構建一個土地NFT項目或者遊戲中的建築。

3D矢量風格動物

通過改變粗體內容,生成不同的矢量動物形象

kawaii low poly panda character, 3d isometric render, white background, ambient occlusion, unity engi

3D遊戲風格房間

可改變粗體內容,生成不同的房間

Tiny cute isometric living room in a cutaway box, soft smooth lighting, soft colors, purple and blue color scheme, soft colors, 100mm lens, 3d blender render

通過以上案例我們可以看到,AIGC 可以在圖片設計上輔助甚至取代畫師,你可以創造出獨一無二的藝術風格、角色,而不需要掌握繪畫的技巧,這是生產力的極大進步。

模型訓練

以上工作流使用的是開源的Stable Diffusion 通用模型,它無法生成模型素材中不存在的東西,比如你無法讓它生成一隻無聊猿,模型本身也不知道什麼是無聊猿,所以它存在局限性和時效性。為了解決以上提到的問題,我們可以訓練自己的模型,將需要的素材都放進去,從而使模型輸出內容符合我們的預期,這在NFT 二創、擴展,GameFi 輔助設計等方面都有很大的應用潛力。

展示幾張我訓練的無聊猿模型二創成圖效果,從左到右分別是蝙蝠俠風格,黏土風格,畢加索抽像風格和黃金材質:

當然也可以控制生成與原本項目圖片相似度極高的圖片,下列四張圖片有兩張原圖,兩張用無聊猿模型生成的圖,幾乎很難分辨,你可以猜一下,後面我會揭曉答案。

模型訓練原理很簡單,用自己提供的圖片訓練出一個專屬模型,但是讓普通人從零開始訓練一個AIGC模型是很困難的,好在Stable Diffusion 給我們提供了一些比較簡單的模型訓練方法。

現在常用的技術方案有三種:Fine-Tuning、DreamBooth、Textual-Inversion

特性解釋:

-

Fine-Tuning — 模型訓練、原生框架

-

優點:功能最全,效果最好,prompt 控制精確,是優質精細模型的統一技術方案

-

缺點:訓練複雜,硬件要求高,訓練時間長,訓練圖片需要標記詞

-

DreamBooth — 模型訓練、簡易框架、添加特殊標識符

-

優點:訓練簡單、速度快、硬件要求相對低、不需要精確的圖片標記詞,能較好地生成不同風格的圖片,開放模型最常用方案

-

缺點:受限於 [X][类别] 的表示方式,訓練SD模型中不存在的類效果會差一些,整體出圖質量低於Fine-Tune,模型文件:2-4G

-

Textual-Inversion — 新定義特徵向量,不改變模型本身

-

優點:需要圖片數量少:3-5張,訓練文件小:幾十KB

-

缺點:對於原SD中不存在的創新的物體、畫風等出圖效果不好,暫無商業用例

綜合考慮成本與難度,新手推薦使用DreamBooth 訓練自己的模型,這裡我給大家找了一個最簡單的Colab版本,它可以使用谷歌免費的服務器訓練模型並生成圖片,前期需要處理的素材也最少。

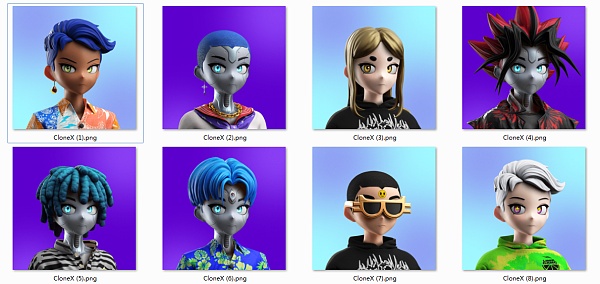

訓練模型之前,你需要訓練使用的準備圖片,初次嘗試最好在10張左右,尺寸512*512,如果圖片尺寸不合適可以使用BIRME 等工具調整。

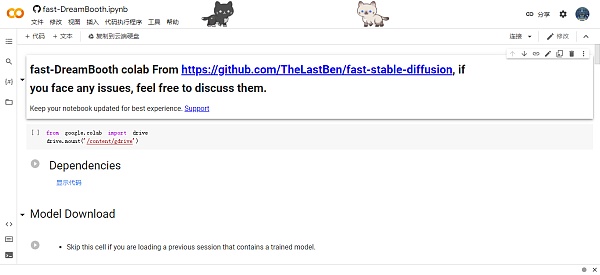

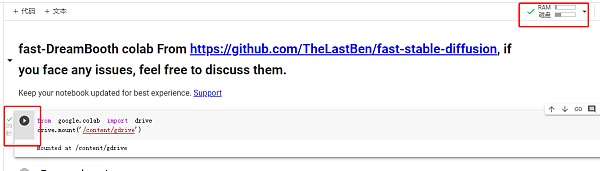

打開上面的鏈接,也就是:https://colab.research.google.com/github/TheLastBen/fast-stable-diffusion/blob/main/fast-DreamBooth.ipynb

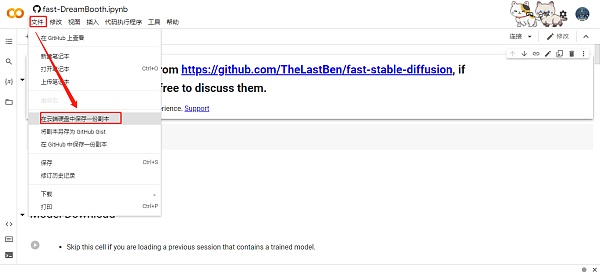

主頁顯示如下,這是一個即時更新的頁面,它不會保存你的更改,你可以直接在這個頁面使用,或者點擊“文件”選擇“在雲端硬盤中保存一份副本”,打開副本頁,這個頁面會保存你的所有更改。

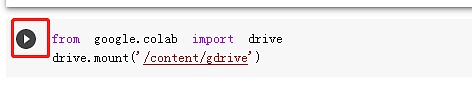

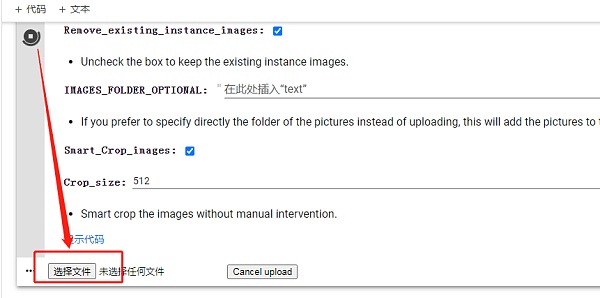

之後我們開始模型訓練,首先點擊第一行的運行按鈕,連接Google雲端硬盤,安裝到gdrive。

運行完成後在按鈕前面會出現綠色的對勾,右上角RAM/磁盤也出現綠色對勾,後面每段程序運行完成的標誌都是這個小對勾。上一段程序運行結束後,點擊下一段的按鈕繼續運行。

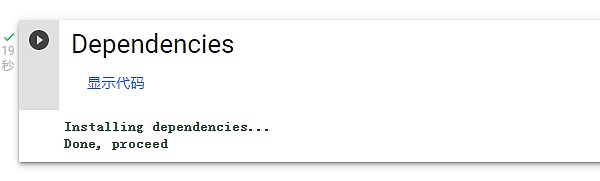

接下來安裝依賴,下載模型

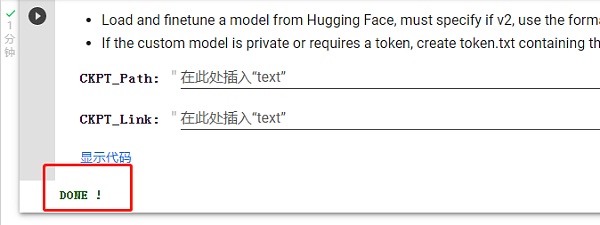

開始正式訓練,首先為你的模型起個名字。

上傳圖片,點擊運行後會出現“選擇文件”按鈕,選定圖片後上傳,我這裡選擇了八張CloneX 的圖片作為訓練素材,並為它們命名為CloneX1-8,這裡對圖片的命名不要與已有單詞相同,它是對你訓練素材的特殊標記。圖片命名方式可以參考下圖。

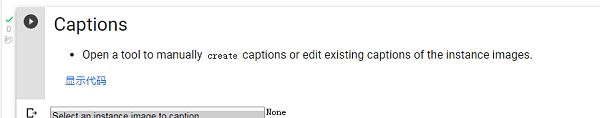

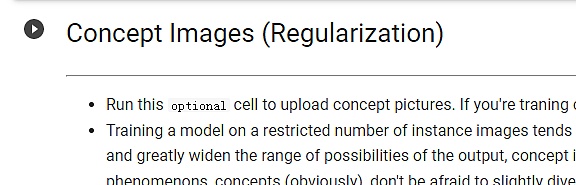

運行Captions,並跳過Concept images

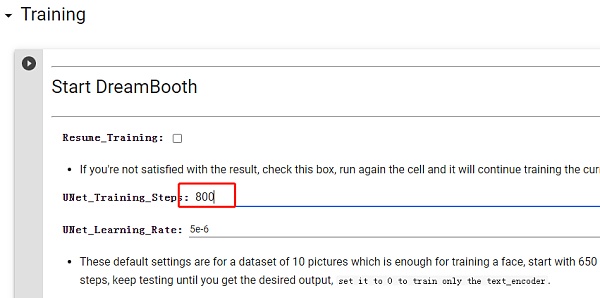

開始訓練,訓練步數設置為圖片數量*100,我是用了八張圖片,這裡選擇800,其他參數暫時不需要調整,等後面熟練掌握了模型訓練方法再進行更精準的訓練。

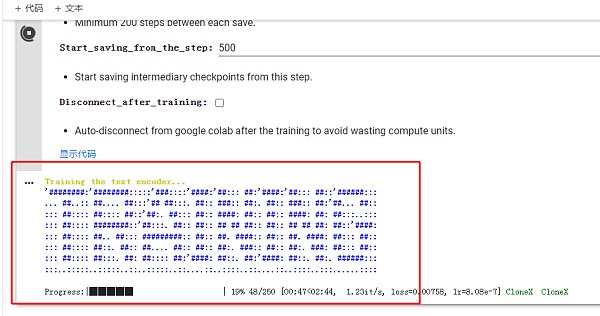

點擊運行,出現以下界面表示訓練開始,等待訓練完成。這裡有兩個訓練過程,一個是訓練文字,一個是訓練圖片。

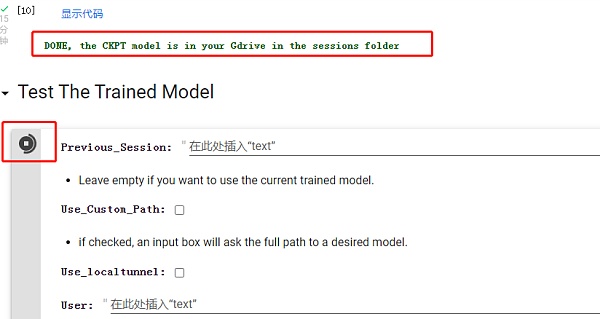

訓練完成後直接運行測試模型,這裡不需要調整參數。

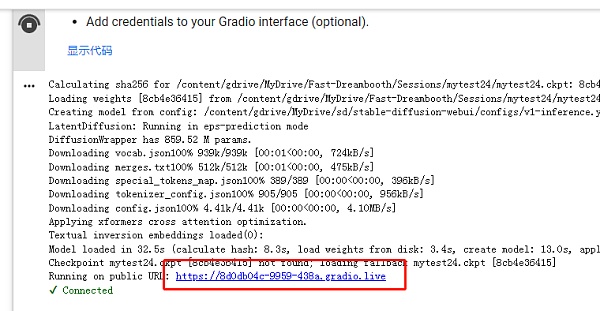

程序運行完後會出現一個鏈接,點擊打開到可以作圖的WebUI 界面。

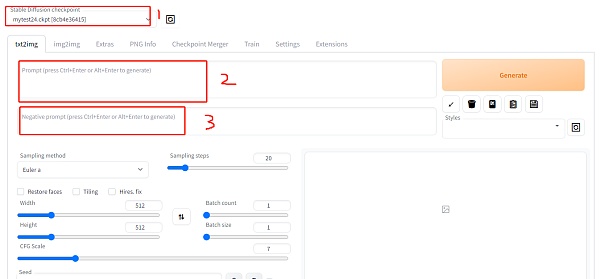

WebUI 的主頁如下,1處選擇使用的模型,2處輸入描述詞,也就是你對想要輸出圖片的內容,3處輸入負面描述詞,也就是你不想要圖片出現什麼內容,3可以空著不填。填寫完描述詞後點擊生成圖片。

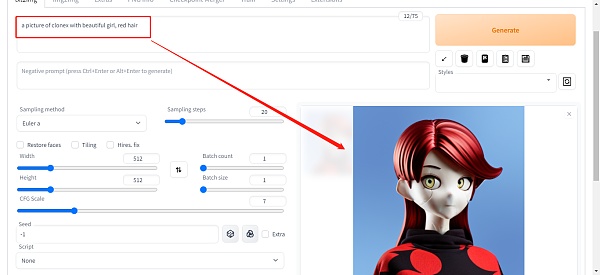

因為我們對圖片的標記是CloneX,所以我們生成圖片時前部分要指定主體,這裡推薦固定句式“a picture of clonex with + ……”,with 後面加對圖片的描述,每個描述詞(短語)之間用逗號隔開。

簡單測試,這裡輸入提示詞“a picture of clonex with beautiful girl, red hair”,結果應該會出現一個紅色頭髮的女生CloneX形象,效果如下圖:

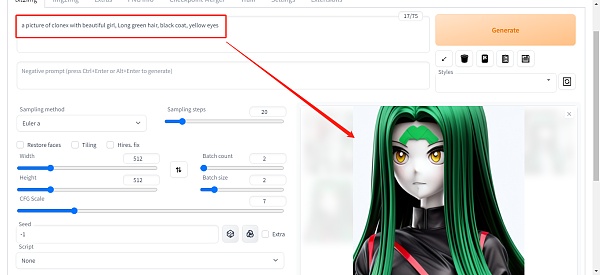

測試2,輸入提示詞:“a picture of clonex with beautiful girl, Long green hair, black coat, yellow eyes”也就是綠色長發、黑色外套、黃色眼鏡的女CloneX,生成效果如下

從以上兩個簡單測試來看,用10張以內的素材圖片訓練的模型就可以很好的生成想要的圖片,而且這些CloneX是原本不存在的,是你創造了它們!以後餵10張圖給AI,它可以給你10,000張圖,這是生產力質的提升。

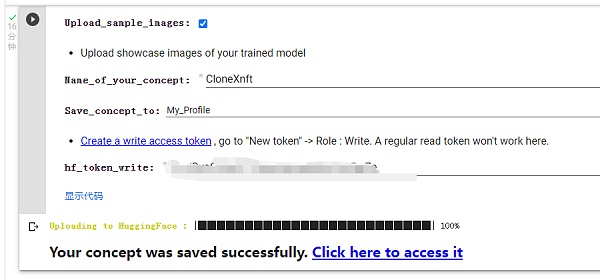

我把這個訓練的模型上傳到了Huggingface,有興趣的朋友可以拿去玩,在訓練過程中遇到什麼問題也可以聯繫我。鏈接:https://huggingface.co/wheart/clonexnft

揭曉答案,無聊猿那四張圖片,前兩張是AI生成的,後面兩張是原圖。

現有AI+Web3項目簡析

隨著AIGC 的興起、ChatGPT 的爆火、微軟對AI 百億投資等事件的鋪墊,Crypto 很多AI 項目也得到了更多的關注,諸如AGIX 之類的AI 概念Token 都迎來了一波不錯的漲幅。但是就目前這些AI+Web3 的項目來看,我並沒有發現真正有想像力的產品。這段時間受到關注的項目大都是很久之前的老項目,所以只能看作是版塊輪動帶動了它們,長線來看沒有好的標的。如果後面出現基於新AI 技術做的產品或許可以關注。

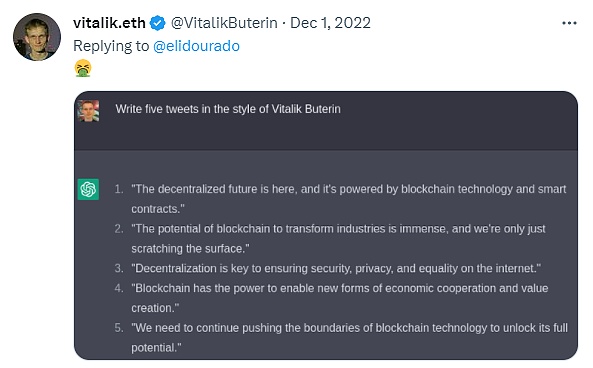

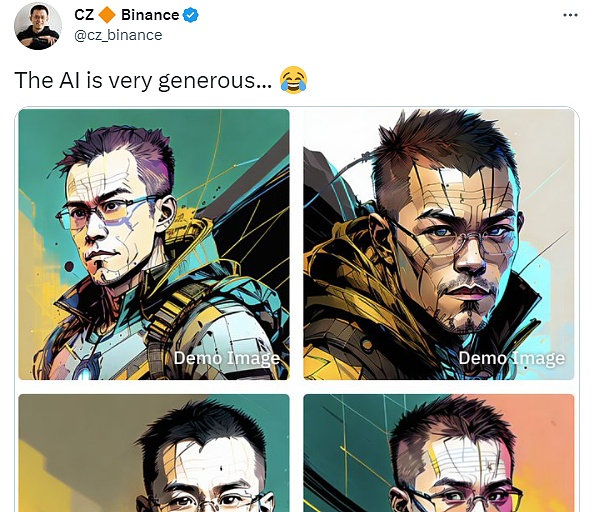

目前很多Crypto 大佬,像CZ、Vitalik 都對AI 技術產生了興趣,所以對於AI+Web3 之後的發展,我個人認為還是值得期待的。

總結

綜合來看,目前AIGC 在Web3 的應用還處於非常初級的階段。現階段利用好AI 工具可以對項目的設計、開發、運營工作提供極大的便利,下一階段肯定會出現更多優秀的產品,我們要做的就是學習、使用、分析、發現,比大部分人多走一步,不錯過AIWeb3 這趟車。