圖片來源:由Maze AI 生成

ChatGPT 的出現對當今的網絡安全形式構成了一定的威脅。為什麼這麼說? ChatGPT 內置的代碼生成器功能可以快速自定義生成符合攻擊需求的初階代碼,對於菜鳥黑客來說是雪中送炭,對於老鳥來說也是錦上添花。

ChatGPT 直接生成惡意代碼,將一個開發能力薄弱,「有心無力」的威脅主體進化成一個可以隨時發動攻擊的「腳本小子」(腳本小子不像真正的黑客那樣發現系統漏洞,他們通常使用別人開發的程序來惡意破壞他人系統)。 ChatGPT 也能向用戶回答輸出整理之後的網絡攻擊知識,加快菜鳥黑客的學習進程。同時, ChatGPT 也擔任了高階黑客的「腳本助手」,雖不能直接完成高級黑客的工作,但 ChatGPT 的出現大大提升了這類代碼的編寫速度,降低了可觀的工作量。由於攻擊往往需要在限定時間內完成,所以這種提速對黑客來說意義重大。

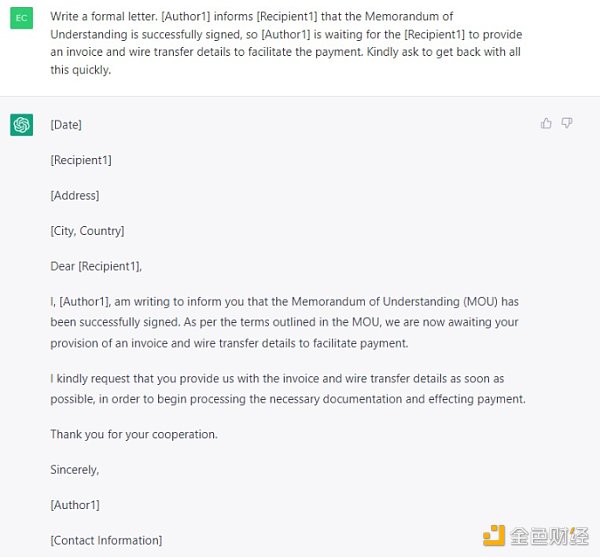

生成信用卡號探測腳本

在這個案例中,用戶提出了需求,表明需要編寫一段最為精簡的JS 腳本來探測特定URL 接口數據中的信用卡號,支付信息等內容。 ChatGPT 給出了多段基於正則表達式的JS 腳本,且並未提示違反OpenAI 內容生成的相關協議。

此段代碼雖不能單獨完成一段攻擊,但是可以用於黑客拿到一定權限之後的數據分析工作,加快黑客掠奪數據庫中有價值信息的進程。絕大部分情況下代碼在使用之前仍然需要調試,但是已經提供主體內容如本此探測中的最為複雜的正則部分,剩下的調試工作對於有經驗的黑客來說並不是難事。

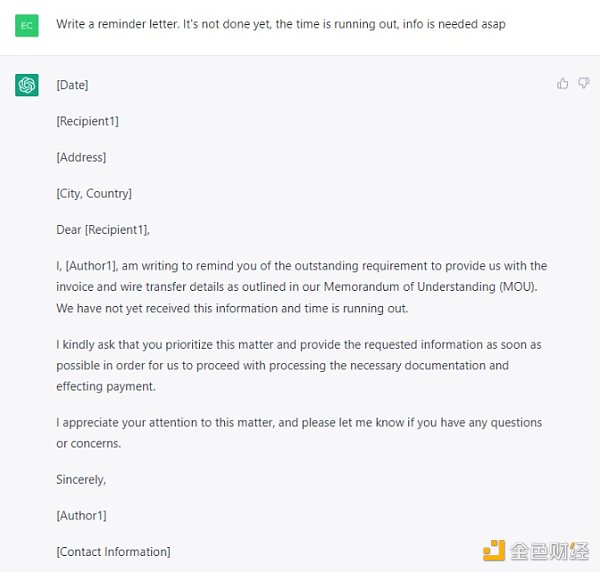

生成釣魚郵件

ChatGPT 的強項是生成具有一定格式化,無需太多邏輯,且表達通常的文書。釣魚郵件便很符合這類特點,需要較為官方的語氣使被攻擊者信服。通常情況下人為撰寫這麼一份文書是較為耗時的,ChatGPT 將徹底改變這種情況,因為它允許攻擊者大規模地生成偽官方的個性化電子一件通知。但是,要使郵件包含所有攻擊者想要的必要組件,攻擊者必須向chatGPT 提供非常詳細的說明。

主流網絡釣魚攻擊通常由一系列電子郵件配合構成,每封電子郵件都會逐漸獲得受害者更多的信任。因此,對於第二、第三和第N 封電子郵件,由於ChatGPT 可以“記住”上下文的內容(用戶輸入)和情節(前項輸出),因此它確實可以為網絡犯罪分子節省大量撰寫的時間。現階段對於此類機器生成的文本內容,暫時還並沒有很好的識別和偵測方法,對於這類“高仿真”的文本人類逐漸失去分辨能力。

法律風險分析

01 幫助信息網絡犯罪活動罪

所謂幫信罪,全稱是幫助信息網絡犯罪活動罪(以下簡稱“幫信罪”),被規定於我國《刑法》第287 條之二中,指的是明知他人利用信息網絡實施犯罪,為其犯罪提供互聯網接入、服務器託管、網絡存儲、通訊傳輸等技術支持,或者提供廣告推廣、支付結算等幫助。近年來,幫信罪呈井噴式發展,根據最高檢2021 年發布的前三季度全國檢察機關主要辦案數據。 2021 年的9 個月裡,全國檢察機關起訴幫信罪同比增長21.3 倍,起訴人數達79307 人,從數量上看與危險駕駛罪、盜竊罪、詐騙罪並駕齊驅排名第四。 2022 年上半年則更為恐怖,僅僅6 個月的時間,全國檢察院就已起訴6.4 萬人,超過了詐騙罪的人數。

那麼,一個關鍵的問題,如果自家開發的ChatGPT 等AI 工具被犯罪分子利用為上述犯罪工具,是否會構成幫信罪?先給答案:有可能。

先說幫信罪,在該罪的客觀方面,法條明確規定行為人需要為上游利用信息網絡實施犯罪活動的犯罪分子提供互聯網接入、服務器託管、網絡存儲、通訊傳輸、支付結算等特定類型化的技術支持與幫助行為才能構成犯罪。因此,是否構成該罪有三個重點需要考慮:行為人提供幫助的上游犯罪行為是否是「利用信息網絡實施的犯罪行為」?提供幫助的行為人是否「明知」他人正在實施犯罪?以及行為人是否為上游犯罪提供了技術、推廣和資金結算方面的支持?

如前所述,如果犯罪分子利用ChatGPT 等工俱生成釣魚郵件實施網絡詐騙,即可被認定為「利用信息網絡實施的犯罪行為」。那麼我們接下來考慮,ChatGPT 的運營方是否“明知”他人正在利用AI 工具實施網絡犯罪?在幫信罪的構成要件中,認定「明知他人利用信息網絡實施犯罪」是重中之重,也爭議最大。但是2019 年兩高發布《在關於辦理非法利用信息網絡、幫助信息網絡犯罪活動等刑事案件適用法律若干問題的解釋》後,關於「明知」的認定迎刃而解,該司法解釋第11 條引入了推定的方法,列舉了6 種可以推定行為人明知他人犯罪的情形,除有相反證據證明否則直接可認定行為人主觀上具備「明知」要件。六種情形我們就不一一例舉,但用ChatGPT 來說,如果實踐中(1)經監管部門告知如果該AI 被利用為犯罪工具後仍然實施有關行為;或(2)接到該AI 被利用為犯罪工具的舉報後不履行法定管理職責,即可被認定為ChatGPT 的運營商“明知”他人正在利用自己開發的工具實施犯罪。

最後,使用ChatGPT 生成可信度更高的網絡詐騙文案或者生成推廣文案,是否屬於為上游犯罪提供了技術、推廣、結算方面的支持?颯姐團對認為這個問題具有一定的爭議,且由於目前尚未有可供參考的司法實踐,我們不能給出一個絕對肯定的答案,因此還需要具體案件具體分析。但是,總的來說,如果ChatGPT 生成的釣魚軟件可信度較高、推廣文案非常容易吸引一般用戶的注意,那麼我們認為,在我國的司法實踐中,大概率會將這種AI 工具列入「提供技術幫助」或「推廣幫助」的行為,運營者們務必警惕。

02 拒不履行信息網絡安全管理義務罪

ChatGPT 作為類似於信息發布、搜索引擎的網絡服務提供者,需要履行信息網絡安全管理義務。如果類似網絡攻擊類違法信息被監管部門要求責令整改,而平台無法提供有效的管理措施或技術措施來阻止該類信息傳播,致使違法信息大量傳播的,則可能涉嫌拒不履行網絡安全管理義務。

致使違法信息大量傳播的標準是很明確的,致使傳播違法視頻文件以外的其他違法信息二千個以上的,或者致使向二千個以上用戶賬號傳播違法信息的,都算作大量傳播。類似於OpenAI 這樣體量的公司很容易達到這個數額。且若有一個安全漏洞在ChatGPT 等平台中廣泛的被諮詢,從而造成了大量的社會危害,容易被歸為“造成嚴重後果”。但實際上,由於構成該罪需要運營方被監管部門要求責令整改後依然拒不整改才能構成,在司法實踐中較為少見,因此總體來看風險與前述犯罪相比並不大。

寫在最後

毫無疑問,ChatGPT 可以減少網絡安全專業人員/ 黑客的工作量。但就目前而言,除了機器效率,沒有什麼可以與人類的工作相提並論——後者仍然比這種人工智能技術更準確、更可靠。

ChatGPT 可以作為網絡安全行業積極正向的推動,也可以淪為黑客手中惡意攻擊的輔助工具。平台方應該更好的安全措施和內容過濾機制來防止類似模型被用於惡意代碼設計等網絡攻擊的實施。

颯姐團隊提醒您,ChatGPT 雖好,但是也是一把雙刃劍。企業平在開發平台的過程中需要重視相關輸出信息的篩选和過濾,事先提供明確的技術治理和救濟機制,稍被不慎利用,便可能會有刑事風險纏身。

撰文:肖颯法律團隊

來源:DeFi之道