AI意識正在覺醒?

來源:Founder Park

就算在新產品滿天飛,商業文明正在被AI 重建的當下,我們仍然不知道,這些令人驚嘆的技術是如何運作的。

AI,語言模型,它是個黑箱(black box),人類無法理解,我們甚至不知道怎樣研究才能夠理解。

但如果,研究這個黑箱的不是人類,而是AI 自己呢?

這是一個令人好奇但又非常危險的想法。因為你甚至不知道,這一研究方法產生的結果,是否會徹底顛覆多年來人類對人腦和AI 的理解。

但是有人這樣做了。幾小時前,OpenAI 發布了最新的研究成果,他們用GPT-4 解釋GPT-2 的行為,獲得了初步的成果。

毫不誇張地說,人們震驚極了:「求求你們讓它離覺醒遠點吧!」

「AI 理解AI,然後很快,AI 訓練AI,然後再過幾年,AI 創造新的AI。」

但客觀來說,學術界為之感到興奮:「瘋了,OpenAI 剛剛搞定了可解釋性問題。」

人與機器之間是GPT-4

OpenAI 剛剛在官網發布博客文章《語言模型可以解釋語言模型中的神經元》(Language models can explain neurons in language models)。

簡單來說,他們開發了一個工具,調用GPT-4 來計算出其他架構更簡單的語言模型上神經元的行為,這次針對的是GPT-2,發佈於4 年前的開源大模型。

大模型(LLM)和人腦一樣,由「神經元」(neurons)組成,這些神經元會觀察文本中的特定規律,進而影響到模型本身生產的文本。

舉例來說,如果有一個針對「漫威超級英雄」的神經元,當用戶向模型提問「哪個超級英雄的能力最強」時,這個神經元就會提高模型在回答中說出漫威英雄的概率。

OpenAI 開發的工具利用這種規則制定了一套評估流程。

開始之前,先讓GPT-2 運行文本序列,等待某個特定神經元被頻繁「激活」的情況。

然後有三個評估步驟:

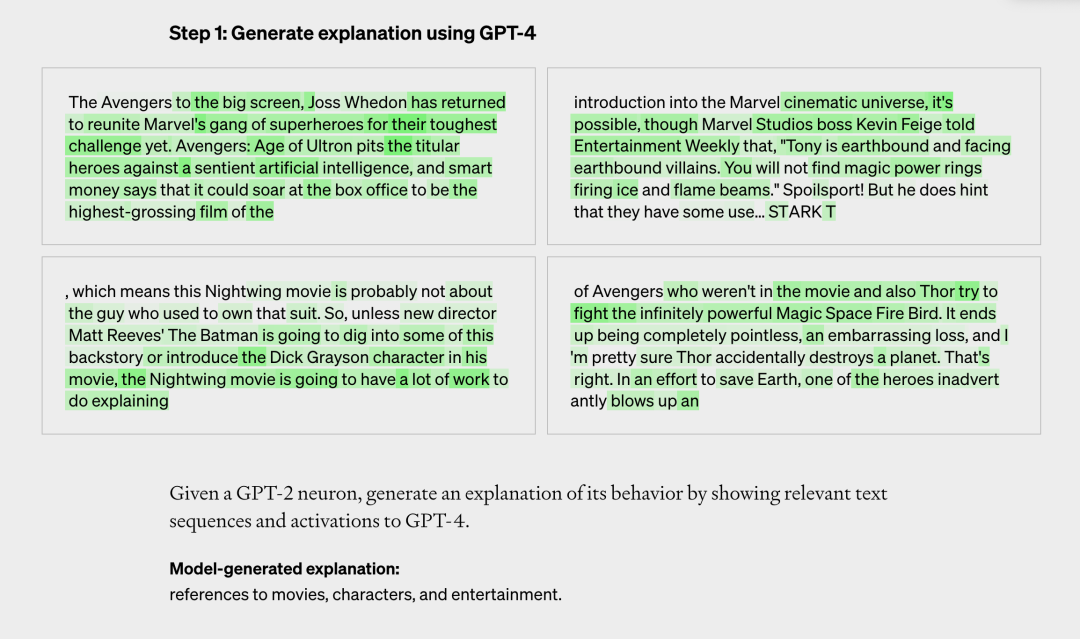

第一步,讓GPT-4 針對這段文本,生成解釋。比如在下面的案例中,神經元主要針對漫威內容。 GPT-4 接收到文本和激活情況後,判斷這與電影、角色和娛樂有關。

第二步,用GPT-4 模擬這個GPT-2 的神經元接下來會做什麼。下圖就是GPT-4 生成的模擬內容。

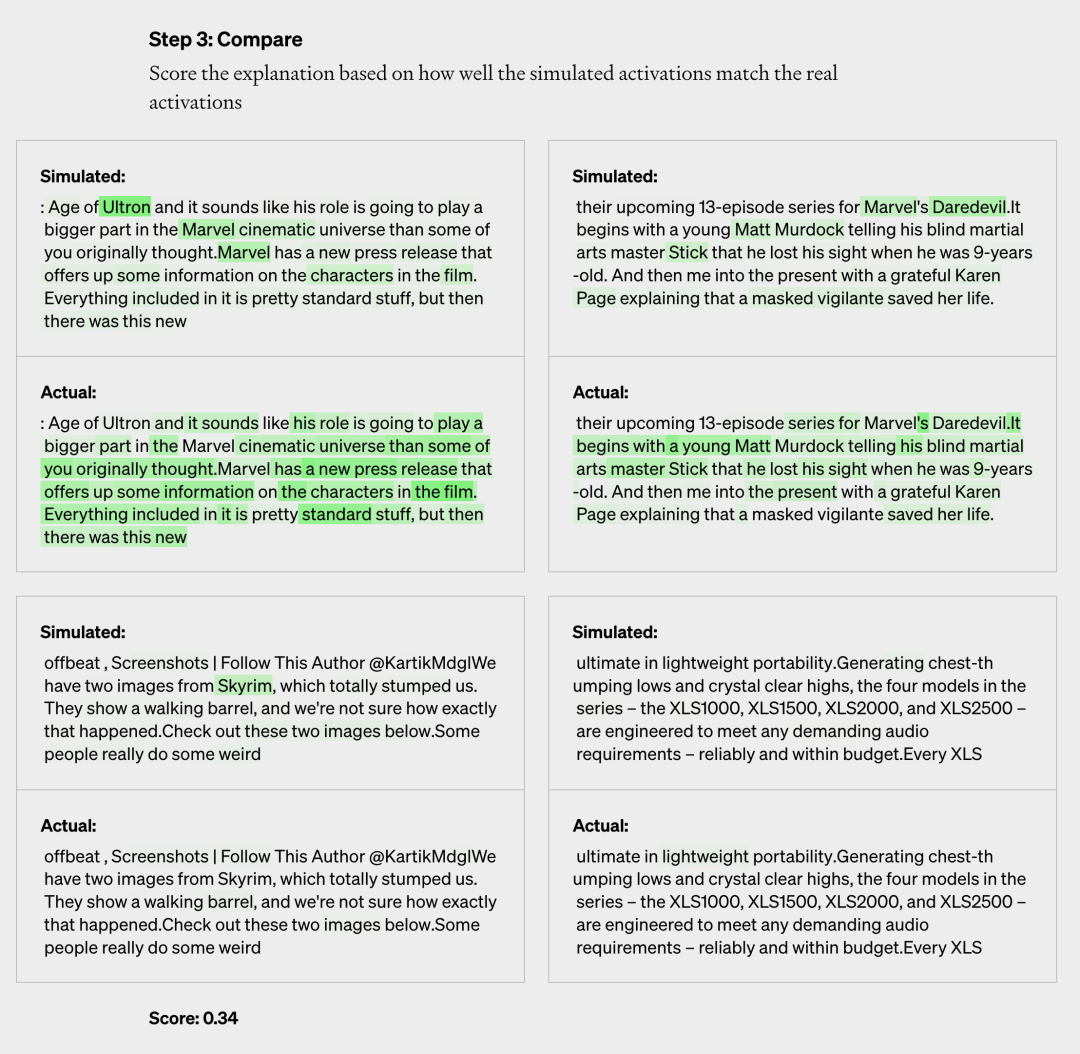

最後一步,對比評估打分。對比4 代模擬神經元和2 代真實神經元的結果,看GPT-4 猜的有多準。

通過這樣的方法,OpenAI 對每個神經元的行為作出了初步的自然語言解釋,並對這種解釋和實際行為的匹配程度進行了評分。

最終他們對GPT-2 中307200 個神經元全部進行了解釋,這些解釋彙編成數據集,與工具代碼一起在GitHub 上發布。

超越語言的機器,人類無法理解的機器

據OpenAI 在博客文章中表示,目前GPT-4 生成的解釋還不完美,尤其要解釋比GPT-2 更大的模型時,表現效果很差,「可能是因為後面的layer 更難解釋」。

對於GPT-2 解釋的評分大多也非常低,僅有1000 個左右的解釋獲得了較高的評分(0.8 以上)。

OpenAI 可拓展對齊團隊的Jeff Wu 表示,「大多數解釋的得分很低,或者無法解釋實際神經元那麼多的行為。比如,許多神經元以一種難以判斷的方式保持活躍,它們在五六件事上保持激活,但卻沒有可以辨別的模式。有時候存在明顯的模式,但GPT-4 有無法找到它。」

雖然現階段成績不好,但是OpenAI 卻比較有信心,他們認為可以使用機器學習的方式提高GPT-4 產出解釋的能力。

比如通過反復產出解釋,並根據激活情況修改解釋;或者使用更大的模型作出解釋;以及調整解釋模型的結構等等。

OpenAI 還提到,這一方法目前還有很多局限性。

- 使用簡短的自然語言進行解釋,也許並不匹配神經元可能非常複雜的行為,不能簡潔地進行描述。神經元可能會具備多個不同概念,也可能,會具備一個人類沒有語言描述甚至無法理解的概念。

- 最終OpenAI 希望能夠自動化找到並解釋能夠實現複雜行為的整個神經迴路,而目前的方法只解釋了神經元的行為,並沒有涉及下游影響。

- 解釋了神經元的行為,但沒有解釋產生這種行為的機制。這意味著即使是拿了高分的解釋,也只能描述相關性。

- 整個過程是計算密集型的。

在論文中,OpenAI 表示:「語言模型可能代表了人類無法用語言表達的陌生概念。這可能是因為語言模型關心不同的事情,比如統計結構對下一個token預測任務有用,或者因為模型已經發現了人類尚未發現的自然的抽象,例如在不同領域的類似概念家族。」

它把LLM 的這種屬性,稱為Alien Feature,在生物領域翻譯為「異類特徵」。

Founder Park 微信後台回复「解釋神經元論文」,獲取論文鏈接和中英對照PDF 鏈接(機翻)。

把對齊問題也交給AI

「我們正試圖開發預測『AI 系統會出現什麼問題』的方法,」OpenAI 可解釋性團隊負責人William Saunders 對媒體說,「我們希望能夠真正做到,讓這些模型的行為和生產的回答是可以被信任的。」

Sam Altman 也轉發博客文章稱:GPT-4 對GPT-2 做了一些可解釋性工作。

可解釋性(interpretability)是機器學習的研究子領域,指的是對模型的行為有清晰的理解和對模型結果的理解能力。

簡單來說,目的就是解釋機器學習模型「如何做到」(how)。

2019 年開始,可解釋性成為機器學習的重要領域,相關研究有助於開發人員對模型進行優化和調整。針對當下AI 模型大規模應用時,亟需解決的可信度(trust)、安全性(safety)和決策參考(decision making)等問題。

如果我們不知道AI 是如何作出決策的,始終把它當做一個黑箱,那麼就算AI 在各種場景下表現得再完美,也無法解決部分人類的信任問題。

OpenAI 這次使用GPT-4 來解決可解釋性的問題,就是希望能夠使用自動化的方式,讓機器完成AI 研究。

「這是我們對齊研究的第三支柱的一部分:我們希望自動化對齊研究。令人期待的是,這一方向能讓它(對齊)與AI 發展的步伐相匹配。」

在2022 年夏天,OpenAI 曾發布文章《我們做對齊研究的方法》(Our approach to alignment research)。

文中提到,宏觀來看,OpenAI 的對齊研究將由三大支柱支撐:

1、利用人工反饋訓練AI

2、訓練AI 系統協助人類評估

3、訓練AI 系統進行對齊研究

「語言模型非常適合自動化對齊研究,因為它們通過閱讀互聯網『預裝』了大量有關人類價值觀的知識和信息。開箱即用,它們不是獨立代理,因此不會在世界上追求自己的目標。」

太快了,連認知都範式革命了

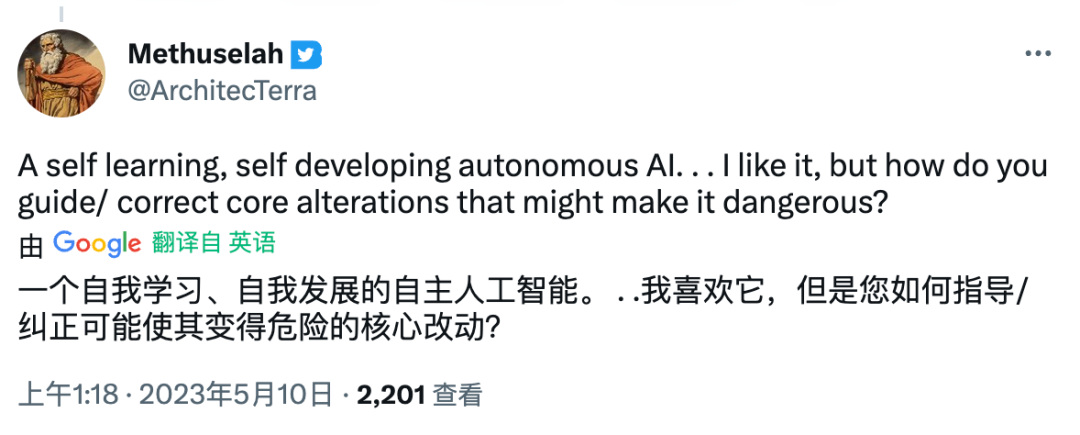

雖然OpenAI 本意很好,但是這樣的研究成果著實嚇壞了網友。

OpenAI 的推文下梗圖橫飛,有不少人在認真地建議OpenAI 搞慢點。

「用我們不理解的東西,解釋另一個我們不理解的東西,這合理嗎?」

「護欄都被你撤了」

「這太迷人了,但也讓我感到極度不適。」

「自然創造了人類來理解自然。我們創造了GPT-4 來理解自己。」

「我們要怎麼判斷解釋者是好的?這就像… 誰監督著監督者?」(who watches the watchers)

還有人看到了更深的一層:

「大模型很快就能比人類更好地解釋他們自己的思維過程,我想知道我們未來要創造多少新的詞彙,來描述那些AI 發現的概念(概念本身也不准確)?我們還沒有一個合適的詞描述它們。或者,我們是否會覺得這些概念有意義?它們又能教會我們如何認識自己呢?」

另一網友回應道:「人類本身對自己行為的解釋,大多是謊言、捏造、幻覺、錯誤的記憶、事後推理,就像AI 一樣。」

展開全文打開碳鏈價值APP 查看更多精彩資訊