作者:郭渦輪,Mirror

總而言之:

Modulus labs透過鏈下執行ML計算並靈活產生zkp的方式實現了可驗證AI,本文從應用視角重新部署該方案,分析其在哪些場景是剛需的,而在哪些場景需求較弱,最後延牽橫向的和縱向統一的基於公鏈的AI生態模式,主要內容有:

-

需要是否可驗證AI依據:是否修改鏈上數據,以及是否涉及公平和隱私

-

當AI不影響鏈上狀態時,AI可以充當建議者,人們可以透過實際效果判斷AI服務品質好壞,無需對計算過程進行驗證。

-

當影響鏈上狀態時,若該服務針對個人且某隱私有影響,則使用者仍可直接判斷AI服務品質抽取檢驗計算過程。

-

當AI的輸出會影響多人間的公平和個人隱私時,例如用AI給社區成員評價並分配獎勵,用AI優化AMM,或涉及生物數據,就會希望對AI的計算進行審查,這是可以的驗證AI可能找到PMF的位置。

-

縱向的AI應用生態:由於可驗證AI的尾部是智能合約,可驗證AI應用之間既然AI和原生dapp之間或許可以實現消耗信任地交互調用,這是潛在的可組合的AI應用生態

-

橫向的AI應用生態:公鏈系統可以為AI服務商處理服務付費、支付瓶頸協調、用戶需求和服務內容的匹配等問題,讓用戶獲得自由度更高的去中心化AI服務體驗。

1. Modulus Labs簡介與應用案例

1.1 簡介與核心方案

Modulus Labs是一家「鏈上」AI公司,其認為AI可以顯著提升智能合約的能力,使web3應用變得更加強大。但AI評價web3時有一個矛盾,就是AI的運作需要大量算力,而鏈下計算中的AI是一個黑盒子,這並不符合web3去信任、可驗證的基本要求。

因此,Modulus Labs 峰會zk rollup【鏈下修復+鏈上驗證】的方案,提出了可驗證AI 的架構,具體為:ML 模型在鏈下運行,另外在鏈下為ML 的計算過程生成一個zkp ,透過該zkp 可以驗證鏈下模型的架構、權限重和輸入(inputs),當然這個zkp 也可以發佈到鏈上由智能合約進行驗證。此時AI 和鏈上合約可以進行更多去信任的交互,大概實現了「鏈上AI」。

基於可驗證的AI 思路,Modulus Labs 目前推出了三個「鏈上AI」應用,同時也提出了許多可能的應用情境。

1.2 應用案例

-

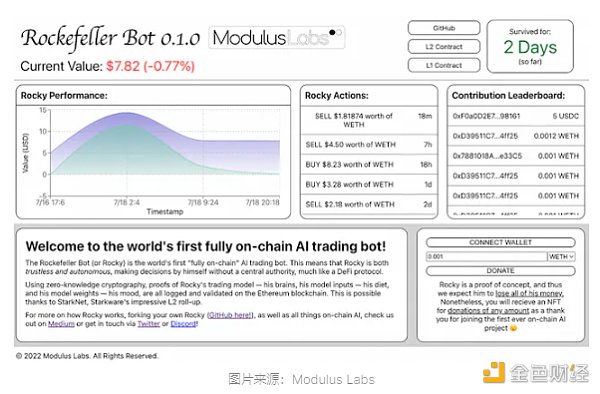

第一個推出的是Rocky bot,一個自動交易AI。 Rocky由wEth/USDC交易對的歷史資料訓練而來。其根據歷史資料判斷未來weth走勢,做出交易決策後會為決策過程(計算過程)產生一個zkp ,轉送L1 發送訊息觸發交易。

-

第二個是鏈上西洋棋遊戲“Leela vs the World”,遊戲雙方是AI和人,棋局情況放在合約裡。玩家透過錢包進行操作(與合約互動)。而AI讀取新的棋局情況,完成判斷,並為整個計算過程生成zkp ,這兩步都是在AWS 雲上,而zkp 交由鏈上的合約驗證,驗證成功後調用棋局合約“下棋” 。

-

第三個是「鏈上」AI藝術家,並推出了NFT系列zkMon,核心在於AI產生NFT並發佈至鏈上,同時產生一個zkp,用戶透過zkp查驗自己的NFT是否產生對應的AI模型。

此外,Modulus Labs 也提及了其他一些例子:

-

利用AI評估個人鏈上數據等信息,產生個人積分獎勵,並發布zkp供用戶驗證;

-

利用AI優化AMM的表現,並發布zkp供用戶驗證;

-

利用可驗證的AI幫助隱私項目應對監管壓力,但同時不暴露隱私(可能是利用ML證明此交易並非洗黑錢,同時不暴露用戶地址等資訊);

-

AI天氣預報,同時發布zkp提供所有者查驗鏈下資料可靠性;

-

AI模型比賽,比賽者提交自己的架構和權重,然後用統一的測試輸入跑模型,為裝甲生成zkp,最終契約會自動將獎金發放給模擬者;

-

Worldcoin稱在未來,或許可以讓用戶在本地設備下載完為虹膜生成對應代碼的模型,本地運行模型並生成zkp,這樣鏈上合約可以用zkp驗證用戶的虹膜代碼生成自正確的模型以及合理的虹膜,同時讓生物資訊不離開使用者自己的裝置;

1.3 基於可驗證AI的需求討論不同應用場景

1.3.1 可能需要驗證AI的場景

在Rocky bot的場景下,使用者可能沒有驗證ML計算過程的需求。第一,使用者並沒有專業知識,根本沒有能力做真正的驗證。即使有驗證工具,在使用者看來都是【自己按了一個】按鈕,介面彈窗是告訴自己這次的AI服務確實是由某個模型產生的】,無法確定真實性。第二,使用者沒有需求進行驗證,因為使用者在乎這個ai的意義是否高。當既然不高時使用者就會遷移,永遠會選擇效果最好的模型。總之,當使用者追求的是AI 的最終效果時,驗證過程可能意義不大,因為使用者只需要遷移至效果最好的模型服務。

**一個可能的方案是:AI只作為建議者,使用者自主執行交易。 **當人們把自己的交易目標輸入AI後,AI在鏈下計算並返回一個更好的交易路徑/交易方向,用戶選擇是否進行執行。人們也不需要驗證背後的模型,只需選擇收益最高的產品。

另一種危險但極有可能出現的情況是,人們根本不在乎自己對資產的控制權以及AI腐蝕過程,當一個自動賺錢的機器人出現時,人們甚至願意把錢直接託管給它,正如將代幣打入CEX或傳統銀行進行理財一般。人們並不會在乎背後的原理,只能在乎他們最後得到多少錢,甚至只能在乎項目方給其顯示賺了多少錢,因為這種服務可能也能夠快速獲取大量用戶,甚至比使用可驗證AI的專案方產品迭代速度更快。

退一步來看,如果AI完全不參與鏈上狀態修改,那麼如果將鏈上資料拉下來為使用者進行消耗,則也沒有為計算過程產生ZKP的需求。這裡將這類應用程式變成【資料服務】 】,以下是幾個案例:

-

Mest提供的聊天框是典型的數據服務,用戶可以用問答的方式了解自己的鏈上數據,例如詢問自己在nft上花了多少錢;

-

ChainGPT是一個多功能的AI助手,它可以在交易前為你解讀智能合約,告訴你是否與正確的池子進行交易,或者告訴你交易是否可能被夾或搶跑。 ChainGPT也準備做AI新聞推薦,輸入提示自動產生圖片並發佈成NFT等各種服務;

-

RSS3 提供了選擇AIOP ,使用戶可以自己想要什麼上鏈數據,並做一定的上鏈數據,從而方便地選擇特定的上鍊數據訓練AI;

-

DefiLlama 和RSS3 也開發了ChatGPT 插件,使用者可以透過對話取得鏈上資料;

1.3.2 需要驗證AI的場景

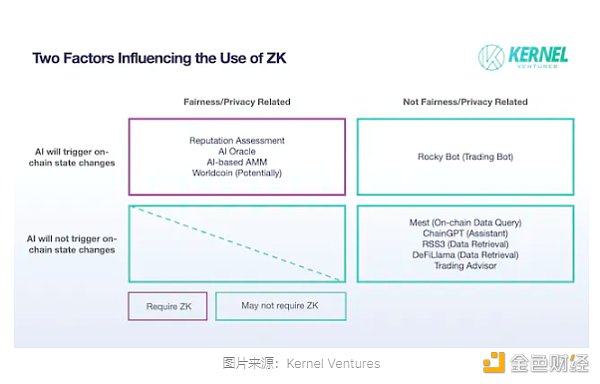

本文認為涉及多個,涉及公平和隱私的場景,需要ZKP 提供驗證,在此針對Modulus Labs 提及的幾個應用進行討論:

-

當社群基於AI生成的個人獎勵發放獎勵時,社群成員必然會要求對決策過程進行審查,而這個決策過程就是ML的計算過程;

-

AI優化AMM的涉及多個之間的利益分配,也需要定期查驗AI的計算過程;

-

在平衡隱私和監管時,ZK是目前比較好的方案之一,若服務方在服務中使用ML處理隱私數據,則需要為整個計算過程產生ZKP;

-

由於預測機影響範圍較廣,若由AI進行調節,就需要定期產生ZKP來檢查AI是否正常運作;

-

在比賽中,民眾和其他參賽者有需求查驗ML的損壞是否符合比賽規範;

-

在世界幣的潛在案例中,保護個人生物數據同樣是抑制需求;

總體來說,當人工智慧類似一個決策者時,其輸出影響範圍極廣且涉及到多方的公平時,而人們會要求對決策過程進行審查,或者只是簡單地保證人工智慧的決策過程沒有大的問題,而保護個人隱私就是非常直接的需求了。

因此,【AI輸出是否鏈上狀態】和【修改是否需要影響公平/隱私】,是判斷AI方案是否可驗證的兩個標準

-

當AI輸出不修改鏈上狀態時,AI服務可以充當建議者的身份,可以透過建議效果判斷AI服務品質好壞,無需對計算過程進行驗證;

-

當AI輸出修改鏈上狀態時,若該服務僅針對個人且不對隱私有影響,則使用者仍可直接判斷AI服務品質檢驗計算過程;

-

當AI的輸出會直接影響多人間的公平性,而AI是自動修改鏈上資料時,社區和公眾就對AI決策過程進行檢驗的需求;

-

當ML處理的資料涉及個人隱私時,同樣需要zk來保護隱私,並提出應對監管要求。

2. 兩種以公鏈為基礎的AI生態模式

無論如何,Modulus Labs 的方案對AI 結合加密貨幣並帶來實際應用價值具有很大的啟示意義。但公鏈體係不僅能夠提升單一AI 服務的能力,而且有潛力建構新的AI 應用生態。新生態帶來了引人注目的Web2的AI服務間關係,AI服務與使用者的協作方式,必然是上下游各個環節的協作方式,我們可以把潛在的AI生態模式歸納為縱向模式和橫向模式兩種。

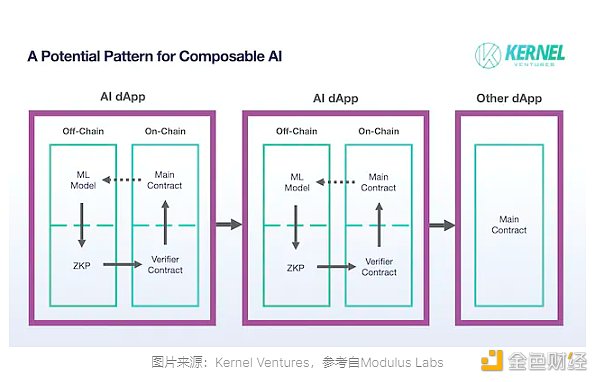

2.1 縱向模式:注意力實現AI之間的可組合性

「Leela vs the World」鏈上國際象棋這個例子有一個特殊的地方,人們可以為人類或AI下注,結束比賽後自動分配代幣。此時zkp的意義不僅提供使用者驗證AI計算的過程,而且是作為觸發鏈上狀態轉換的信任。有了信任保障,AI服務之間,AI和加密貨幣dapp之間也可能擁有dapp等級的可組合性。

可組合AI 的基本單元是【鏈下ML 模型-zkp 生成-鏈上驗證合約-主合約】,該單元在「Leela vs the World」的框架中充實,但實際的單一AI dapp 的架構可能和上圖展示的不一樣。一是西洋棋中棋局情況需要一個合約,但現實情況下AI可能不需要一個鏈上合約。但就可組合AI的架構來看,如果主要業務是透過合約來記錄,其他二是主合約影響不一定需要AI dapp本身的ML模型,因為某個AI dapp可能是單向影響的,ML模型處理完成後觸發自身業務相關的合約即可,而該合約又會被其他dapp進行呼叫。

延展來看,合約之間的調用是不同web3應用之間的調用,是個人身份、資產、金融服務、社交資訊的調用,我們可以設想一種具體的AI應用的組合:

-

Worldcoin 使用ML 為個人虹膜資料產生虹膜程式碼以及zkp;

-

AI應用先此DID是否為真人(背後有虹膜資料),根據鏈上信譽為使用者分配NFT;

-

網路服務根據使用者擁有的NFT 調整網路共用;

-

…..

在公鏈框架下的AI間互動並不是一件一起討論的事情,全鏈遊戲領域生態貢獻者Loaf曾提出,AI NPC之間可以和玩家一樣交互交易,使得整個經濟系統可以自我優化並自動AI Arena開發了一個AI自動對戰的遊戲,用戶首先購買一個NFT,一個NFT代表一個戰鬥機器人,背後是一個AI模型。使用者先自己玩遊戲,然後把數據交換AI模擬學習,當用戶覺得這個AI夠強的時候就可以放到競技場中和其他AI自動對戰。 Modulus Labs提到的AI Arena希望把這些AI都轉化為可驗證的AI。這兩個案例中都看到了AI間進行,並直接互動在交易時修改鏈上資料的可能性。

但如何組合AI 在具體實作上終止大量待討論的問題,例如不同的dapp 利用普遍的zkp 或驗證合約等。不過在zk 領域也有大量優秀項目,例如RISC Zero 在鏈下進行複雜的缺血性zkp發佈至鏈上這方面有許多進展,或許天就可以組合出合適的方案。

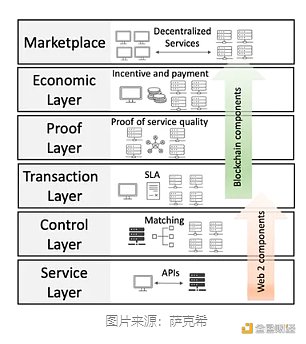

2.2 橫向模式:實現停車場去中心化的AI服務平台

在這方面,我們主要介紹一個叫做SAKSHI的去中心化AI平台,它由來自普林斯頓、清華大學、伊利諾大學香檳分校、香港科技大學、Witness Chain和Eigen Layer的人員共同提出。其核心目標是讓使用者能夠以更去中心化的方式獲得AI服務,使得整個流程更加去信任化和自動化。

SAKSHI的架構可分為六層:分別是服務層(Service Layer)、控制層(Control Layer)、交易層(Transation Layer)、證明層(Proof Layer)、經濟層(Economic Layer)和市場層(Marketplace ) )

市場是最接近用戶的層次,市場上有聚合器來代表不同的AI供應商向用戶提供服務,透過用戶聚合器下單並和聚合器就服務品質和支付價格達成協議(協議被稱為SLA) -服務等級協定)。

接下來的服務層會為客戶端頭部提供API,然後客戶端頭部向聚合器發起ML推理請求,請求被傳送至匹配AI服務提供方的伺服器(傳輸請求所使用的路由是控制層的一部分) 。 ,服務層和控制層類似一個擁有多個伺服器的web2的服務,但不同的伺服器由不同的主體運營,單一伺服器透過SLA(先前的服務協定)和聚合器進行關聯。

SLA以智能合約的形式部署在鏈上,這些合約都屬於交易層(註:這裡方案中部署在見證鏈上)。交易層會記錄記帳服務訂單的當前狀態,並用於協調使用者、聚合器和服務提供方,解決支付難題。

為了讓交易層在處理問題時有據可依,論證層(Proof Layer)將檢驗服務是否符合SLA 的約定使用模型。但SAKSHI 並沒有選擇為ML 運算過程產生zkp ,而是用樂觀論證的思路,希望建立挑戰者節點網路來對服務進行檢驗,節點受到見證鏈承擔。

雖然SLA 和挑戰者節點網路都在Witness Chain 上,但在SAKSHI 的方案中,Witness Chain 並不打算用改造自己的代幣勵志實現獨立的安全性,而是透過Eigen Layer 來借用以太坊的安全性,因此整個經濟層其實是依託於Eigen Layer 的。

可以看出,SAKSHI圍繞AI服務方和使用者之間,將不同的AI用去中心化的方式組織起來為使用者提供服務,這形成了一個橫向的方案。 SAKSHI的核心所在,它讓AI服務重點更集中於管理自己的鏈下模型計算,透過鏈上協議完成用戶需求和模型服務的撮合、服務的支付和服務品質的驗證,並嘗試自動化解決支付難題。當然,目前SAKSHI還是一個理論階段,同樣有大量執行的細節值得確定。

3.未來展望

無論是可組合AI或是去中心化AI平台,公鏈的AI生態模式似乎都有共通之處。例如,AI服務商均不直接和使用者進行對接,其只需提供ML模型並在鏈下進行計算支付、難題解決、用戶需求和服務之間的撮合,都可以透過去中心化的協議解決。公鏈作為一種去信任的基礎設施,減少了服務方和使用者之間的難度,此時使用者也擁有更高的自主權。

以公鏈為應用基礎的優點雖然老生常談,但也適用於AI服務。而AI應用和存粹的dapp應用不同的場所,AI應用無法將全部計算放在鏈上,所以用zk還是樂觀證明讓AI服務以更多去信任的方式接入公鏈系統。

隨著帳戶抽像等一系列體驗優化方案的落地,使用者可以感知不到助記詞、鍊和gas等的存在,這讓公鏈生態在體驗上接近web2,而用戶可以獲得比web2更高的服務自由度及可組合性,這讓使用者產生了更大的吸引力,以公鏈為基礎的AI應用生態值得期待。