原文作者:Zeke

原文來源:YBB Capital

前言

2月16日,OpenAI公佈了最新的文字控制視頻生成擴散模型“Sora”,透過多段涵蓋的廣泛視覺數據類型的高品質生成視頻,展現了生成式AI的又一個里程碑時刻。不同於Pika這類AI視訊生成工具仍處於用多張圖像生成幾秒鐘視訊的狀態,Sora透過在視訊和圖像的壓縮潛在空間中訓練,將其分解為時空位置補丁,實現了可擴展的視訊生成。除此之外模型也體現出了類比實體世界和數位世界的能力,最終呈現的60秒Demo,說是「物理世界的通用模擬器」也不為過。

而在建構方式上,Sora延續了先前GPT模型「來源資料-Transformer-Diffusion-湧現」的技術路徑,這意味著其發展成熟同樣需要算力作為引擎,且由於視訊訓練所需資料量遠大於文本訓練的資料量,對於算力的需求還將進一步拉大。但我們在早期的文章《潛力賽道前瞻:去中心化算力市場》中已經探討過算力在AI時代的重要性,並且隨著近期AI熱度的不斷攀升,市面上已經有大量算力項目開始湧現,而被動受益的其它Depin計畫(儲存、算力等)也已經迎來一波暴漲。那麼除了Depin之外,Web3與AI的交織還能碰撞出怎樣的火花呢?這條賽道裡還蘊含著怎樣的機會?本文的主要目的是對過往文章的一次更新與補全,並思考AI時代下的Web3存在哪些可能。

AI發展史的三大方向

人工智慧(Artificial Intelligence)是一門旨在模擬、擴展和增強人類智慧的新興科學技術。人工智慧自二十世紀五、六十年代誕生以來,在經歷了半個多世紀的發展後,現已成為推動社會生活和各行各業變革的重要技術。在這過程中,符號主義、連結主義和行為主義三大研究方向的相互交織發展,成為如今AI快速發展的基石。

符號主義(Symbolism)

亦稱邏輯主義或規則主義,認為透過處理符號來模擬人類智能是可行的。這種方法透過符號來表示和操作問題領域內的物件、概念及其相互關係,並利用邏輯推理來解決問題,尤其在專家系統和知識表示方面已取得顯著成就。符號主義的核心觀點是智能行為可以透過對符號的操作和邏輯推理來實現,其中符號代表對現實世界的高度抽象;

連結主義(Connectionism)

或稱為神經網路方法,旨在透過模仿人腦的結構和功能來實現智慧。此方法透過建構由眾多簡單處理單元(類似神經元)組成的網絡,並透過調整這些單元間的連接強度(類似突觸)來實現學習。連結主義特別強調從資料中學習和泛化的能力,特別適用於模式辨識、分類及連續輸入輸出映射問題。深度學習,作為連結主義的發展,已在圖像辨識、語音辨識和自然語言處理等領域取得突破;

行為主義(Behaviorism)

行為主義則與仿生機器人學和自主智慧系統的研究緊密相關,強調智能體能夠透過與環境的互動學習。與前兩者不同,行為主義不專注於模擬內在表徵或思考過程,而是透過知覺和行動的循環來實現適應性行為。行為主義認為,智慧透過與環境的動態互動、學習而展現,這種方法應用於需要在複雜和不可預測環境中行動的移動機器人和自適應控制系統中時,顯得特別有效。

儘管這三個研究方向存在本質區別,但在實際的AI研究和應用中,它們也可以相互作用和融合,共同推動AI領域的發展。

AIGC原理概述

現階段正在經歷爆炸性發展的生成式AI(Artificial Intelligence Generated Content,簡稱AIGC),便是對於連結主義的一種演化和應用,AIGC能夠模仿人類創造力生成新穎的內容。這些模型使用大型資料集和深度學習演算法進行訓練,從而學習資料中存在的底層結構、關係和模式。根據使用者的輸入提示,產生新穎獨特的輸出結果,包括圖像、影片、程式碼、音樂、設計、翻譯、問題回答和文字。而目前的AIGC基本上由三個要素構成:深度學習(Deep Learning,簡稱DL)、大數據、大規模算力。

深度學習

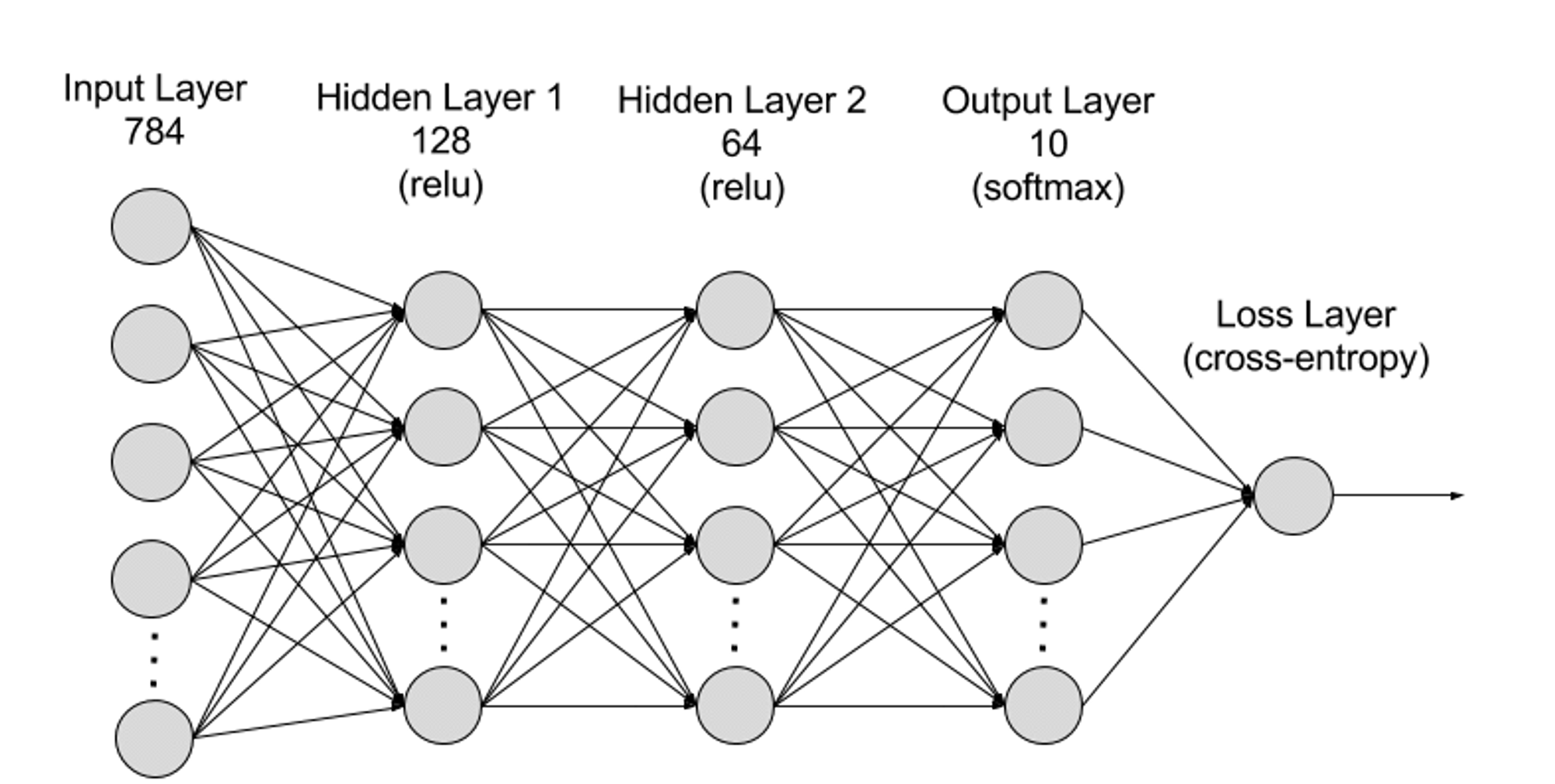

深度學習是機器學習(ML)的一個子領域,深度學習演算法是仿照人腦建模的神經網路。例如,人腦包含數百萬個相互關聯的神經元,它們協同工作以學習和處理資訊。同樣,深度學習神經網路(或人工神經網路)是由在電腦內部協同工作的多層人工神經元組成的。人工神經元是稱為節點的軟體模組,它使用數學計算來處理資料。人工神經網路是使用這些節點來解決複雜問題的深度學習演算法。

從層次劃分神經網路可分為輸入層、隱藏層、輸出層,而不同層之間連接的便是參數。

● 輸入層(Input Layer):輸入層是神經網路的第一層,負責接收外部輸入的資料。輸入層的每個神經元對應於輸入資料的一個特徵。例如,在處理影像資料時,每個神經元可能對應於影像的一個像素值;

● 隱藏層(Hidden Layer):輸入層處理資料並將其傳遞到神經網路中更遠的層。這些隱藏層在不同層級處理訊息,在接收新訊息時調整其行為。深度學習網路有數百個隱藏層,可用於從多個不同角度分析問題。例如,你得到了一張必須分類的未知動物的圖像,則可以將其與你已經認識的動物進行比較。例如透過耳朵形狀、腿的數量、瞳孔的大小來判斷這是什麼動物。深度神經網路中的隱藏層以相同的方式運作。如果深度學習演算法試圖對動物影像進行分類,則其每個隱藏層都會處理動物的不同特徵並嘗試對其進行準確的分類;

● 輸出層(Output Layer):輸出層是神經網路的最後一層,負責產生網路的輸出。輸出層的每個神經元代表一個可能的輸出類別或值。例如,在分類問題中,每個輸出層神經元可能對應於一個類別,而在迴歸問題中,輸出層可能只有一個神經元,其值表示預測結果;

● 參數:在神經網路中,不同層之間的連接由權重(Weights)和偏壓(Biases)參數表示,這些參數在訓練過程中被最佳化以使網路能夠準確地識別資料中的模式和進行預測。參數的增加可以提高神經網路的模型容量,即模型能夠學習和表示資料中複雜模式的能力。但相對應的是參數的增加會提升對算力的需求。

大數據

為了有效訓練,神經網路通常需要大量、多樣且高品質且多源的資料。它是機器學習模型訓練和驗證的基礎。透過分析大數據,機器學習模型可以學習數據中的模式和關係,從而進行預測或分類。

大規模算力

神經網路的多層複雜結構,大量參數,大數據處理需求,迭代訓練方式(在訓練階段,模型需要反覆迭代,訓練過程中需要對每一層計算進行前向傳播和反向傳播,包括激活函數的計算、損失函數的計算、梯度的計算和權重的更新),高精度計算需求,並行計算能力,優化和正則化技術以及模型評估和驗證過程共同導致了其對高算力的需求。

Sora

作為OpenAI最新發布的影片生成AI模型,Sora代表了人工智慧處理和理解多樣化視覺資料能力的巨大進步。透過採用視訊壓縮網路和空間時間補丁技術,Sora能夠將來自世界各地、不同裝置拍攝的大量視覺資料轉換為統一的表現形式,從而實現了對複雜視覺內容的高效處理和理解。依託於文字條件化的Diffusion模型,Sora能夠根據文字提示產生與之高度匹配的影片或圖片,展現出極高的創意和適應性。

不過,儘管Sora在視訊生成和模擬真實世界互動方面取得了突破,但仍面臨一些局限性,包括物理世界模擬的準確性、長視頻生成的一致性、複雜文本指令的理解以及訓練與生成效率。而Sora本質上還是透過OpenAI壟斷級的算力和先發優勢,延續「大數據-Transformer-Diffusion-湧現」這條老技術路徑達成了一種暴力美學,其它AI公司依然存在著通過技術彎道超車的可能。

雖然Sora與區塊鏈的關係並不大,但個人認為之後的一兩年。因為Sora的影響,會迫使其它高品質AI生成工具出現並快速發展,並且將輻射到Web3內的GameFi、社交、創作平台、Depin等多條賽道,所以對於Sora有個大致了解是必要的,未來的AI將如何有效的與Web3結合,也許是我們需要思考的重點。

AI x Web3的四大路徑

如上文所訴,我們可以知道,生成式AI所需的底層基座其實只有三點:演算法、資料、算力,另一方面從泛用性和生成效果來看AI是顛覆生產方式的工具。而區塊鏈最大的作用有兩點:重構生產關係以及去中心化。所以兩者碰撞所能產生的路徑我個人認為有以下四種:

去中心化算力

由於過去已經寫過相關文章,所以本段的主要目的是更新一下算力賽道的近況。當談到AI時,算力永遠是難以繞開的一環。 AI對於算力的需求之大,在Sora誕生之後已經是難以想像了。而近期,在瑞士達沃斯2024年度世界經濟論壇期間,OpenAI執行長山姆‧奧特曼更是直言算力和能源是現階段最大的枷鎖,兩者在未來的重要性甚至會等同於貨幣。而在隨後的2月10日,山姆·奧特曼在推上發表了一個極為驚人的計劃,融資7萬億美元(相當於中國23年全國GDP的40%)改寫目前全球的半導體產業格局,創立一家晶片帝國。在寫算力相關的文章時,我的想像力還侷限在國家封鎖,巨頭壟斷,如今一家公司就想要控制全球半導體產業真的還挺瘋狂的。

所以去中心化算力的重要性自然不言而喻,區塊鏈的特性確實能解決目前算力極度壟斷的問題,以及購置專用GPU價格昂貴的問題。從AI所需的角度來看,算力的使用可以分為推理和訓練兩種方向,主打訓練的項目,目前還是寥寥無幾,從去中心化網絡需要結合神經網絡設計,再到對於硬體的超高需求,注定是門檻極高且落地極難的方向。而推理相對來說簡單很多,一方面在去中心化網路設計上並不複雜,二是硬體和頻寬需求較低,算是目前比較主流的方向。

中心化算力市場的想像空間是巨大的,常常與「萬億級」這個關鍵字掛鉤,同時也是AI時代下最容易被頻繁炒作的話題。不過從近期大量湧現的項目來看,絕大部分還是屬於趕鴨子上架,蹭熱度。總是高舉去中心化的正確旗幟,卻閉口不談去中心化網路的低效率問題。並且在設計上存在高度同質化,大量的項目非常相似(一鍵L2加挖礦設計),最終可能會導致一地雞毛,這樣的情況想要從傳統AI賽道分一杯羹著實困難。

演算法、模型協作系統

機器學習演算法,是指這些演算法能夠從資料中學習規律和模式,並據此做出預測或決策。演算法是技術密集的,因為它們的設計和優化需要深厚的專業知識和技術創新。演算法是訓練AI模型的核心,它定義了資料如何被轉化為有用的見解或決策。較常見的生成式AI演算法例如生成對抗網路(GAN)、變分自編碼器(VAE)、轉換器(Transformer),每個演算法都是為了一個特定領域(例如繪畫、語言辨識、翻譯、影片生成)或者說目的而生,再透過演算法訓練出專用的AI模型。

那麼如此之多的演算法和模型,都是各有千秋,我們是否能將其整合為能文能武的模型?近期熱度高漲的Bittensor便是這個方向的領頭者,透過挖礦激勵的方式讓不同AI模型和演算法相互協作與學習,從而創造出更有效率全能的AI模型。而同樣以此方向為主的還有Commune AI(程式碼協作)等,不過演算法和模型對現在的AI公司來說,都是自家的看門法寶,並不會隨意外借。

所以AI協作生態這種敘事很新穎有趣,協作生態系統利用了區塊鏈的優勢去整合AI演算法孤島的劣勢,但是否能創造出對應的價值目前尚未可知。畢竟頭部AI公司的閉源演算法和模型,更新迭代與整合的能力非常強,例如OpenAI發展不到兩年,已從早期文本生成模型迭代到多領域生成的模型,Bittensor等項目在模型和演算法所針對的領域也許要另闢蹊徑。

去中心化大數據

從簡單的角度來說,將私有資料用來餵AI以及對資料進行標記都是與區塊鏈非常契合的方向,只需要注意如何防止垃圾資料以及作惡,並且資料儲存上也能使FIL、AR等Depin計畫受益。而從複雜的角度來說,將區塊鏈資料用於機器學習(ML),從而解決區塊鏈資料的可訪問性也是一個有趣的方向(Giza的摸索方向之一)。

在理論上,區塊鏈數據可隨時訪問,反映了整個區塊鏈的狀態。但對於區塊鏈生態系統之外的人來說,要取得這些龐大數據量並不容易。完整儲存一條區塊鏈需要豐富的專業知識和大量的專門硬體資源。為了克服存取區塊鏈數據的挑戰,行業內出現了幾種解決方案。例如,RPC提供者透過API存取節點,而索引服務則透過SQL和GraphQL使資料擷取變得可能,這兩種方式在解決問題上發揮了關鍵作用。然而,這些方法有其限制。 RPC服務並不適合需要大量資料查詢的高密度使用場景,經常無法滿足需求。同時,儘管索引服務提供了更有結構的資料檢索方式,但Web3協定的複雜性使得建立高效查詢變得極其困難,有時需要編寫數百甚至數千行複雜的程式碼。這種複雜性對於一般的資料從業者和對Web3細節了解不深的人來說是一個巨大的障礙。這些限制的累積效應凸顯了需要一種更易於獲取和利用區塊鏈數據的方法,可以促進該領域更廣泛的應用和創新。

那麼透過ZKML(零知識證明機器學習,降低機器學習對於鏈的負擔)結合高品質的區塊鏈數據,也許能創造出解決區塊鏈可訪問性的數據集,而AI能大幅降低區塊鏈資料可訪問性的門檻,那麼隨著時間的推移,開發者、研究人員和ML領域的愛好者將能夠存取更多高品質、相關的資料集,用於建立有效和創新的解決方案。

AI賦能Dapp

自23年,ChatGPT3爆火以來,AI賦能Dapp已經是一個非常常見的方向。泛用性極廣的生成式AI,可透過API接入,從而簡化且智慧化分析資料平台、交易機器人、區塊鏈百科等應用。另一方面,也可以扮演聊天機器人(如Myshell)或AI伴侶(Sleepless AI),甚至透過生成式AI創造鏈遊中的NPC。但由於技術障礙很低,大部分都是在接上一個API之後微調,與專案本身的結合也不夠完美,所以很少被人提起。

但在Sora到來之後,我個人認為AI賦能GameFi(包括元宇宙)與創作平台的方向將是接下來的重點。因為Web3領域自下而上的特性,肯定很難誕生出一些與傳統遊戲或是創意公司抗衡的產品,而Sora的出現很可能會打破這一窘境(也許只用兩到三年)。以Sora的Demo來看,其已具備和微短劇公司競爭的潛力,Web3活躍的社區文化也能誕生出大量有趣的Idea,而當限制條件只有想像力的時候,自下而上的行業與由上而下的傳統產業之間的壁壘將被打破。

結語

隨著生成式AI工具的不斷進步,我們未來也將經歷更多劃時代的「iPhone時刻」。雖然許多人對AI與Web3的結合嗤之以鼻,但其實我認為目前的方向大多沒有問題,需要解決的痛點其實只有三點,必要性、效率、契合度。兩者的融合雖處於探索階段,卻並不妨礙這條賽道成為下一個多頭市場的主流。

對新事物永遠保持足夠的好奇心和接納度是我們需要必備的心態,歷史上,汽車取代馬車的轉變瞬息之間便已成定局,亦如同銘文和過去的NFT一樣,持有太多偏見只會和機遇失之交臂。

聲明:本內容為作者獨立觀點,不代表0x财经 立場,且不構成投資建議,請謹慎對待,如需通報或加入交流群,請聯絡微信:VOICE-V。

來源:YBB Capital