作者:Josie;來源:新矽NewGeek

前兩天外媒對Sora核心團隊做了次專訪,看了下原視頻,約等於什麼都沒說,場面神似發改委馬科長講話。

用網友的話來說,就像鏡頭外有個律師拿著槍對著這群人。

Sora已經發布快一個月了,剛發佈時Sora驚為天人,帶給人們無限遐想,甚至有不少人表示AGI就要來了。

然而,目前為止只有少數人用上了Sora,再好的東西用不上,久而久之人們也就失去了興趣。

就在人們把Sora翻得底朝天,該聊的都聊完了,好像實在沒活了,OpenAI派了幾個人出來接受採訪。

16分鐘的專訪裡,Sora的核心團隊成員說了很多內容,但都是一些已知的內容,沒有什麼新的,資訊好像還不如Sora的技術文檔多。

來看看外國人是怎麼打太極拳的。

這次訪談的三位Sora核心成員分別是Bill Peebles、Tim Brooks和Aditya Ramesh。

首先是大家最關心的問題,什麼時候可以用Sora?

“別急,普通人短期內還用不上。”

Sora成員表示,Sora目前尚未對外開放,也沒有具體的時間表。 OpenAI正在收集用戶回饋的階段,希望進一步聊天人們如何使用Sora,有哪些安全工作要做。

既然用不了,那麼探究一下,Sora是如何實現的。

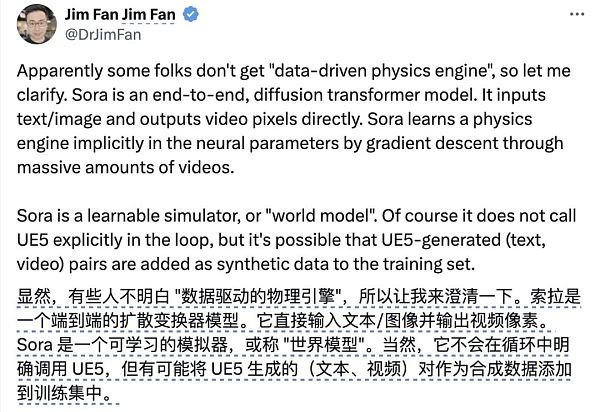

Sora團隊說:Sora是一個視訊生成模型,其工作原理是分析大量視訊資料並學會產生視訊。具體工作方法融合了擴散模型(如DALL-E)和大型語言模型(如GPT系列)的技術。架構上Sora類似介於兩者之間,訓練方式類似DALL-E,但在結構上更像GPT。

結構上更像GPT這一點在Sora剛出現的時候就有不少人分析過,這也算是Sora的一大技術特性。

接下來,也是同樣讓人好奇的,Sora的訓練資料到底來自於哪裡?

在官方發布的Sora生成影片中,無論是咖啡杯中的海盜船,還是東京街頭行走的女性,都在表示Sora似乎理解了許多世界的物理規律。

之前不少民間說法討論,Sora極有可能在資料集中添加了用UE5產生的文字、影片當作合成資料。

面對這樣的問題,Sora成員Tim Brooks沒有明確回應,打了一個太極,表示不方便說得太細,但是他透露,大體上使用的是公開數據和OpenAI被授權使用的數據,並分享了一個「技術創新」。

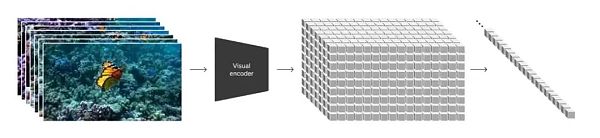

以往,不論是影像還是影片產生模型,通常會以非常固定的尺寸進行訓練,例如只有一個解析度的影片。

在Sora的訓練中,他們將各種各樣的圖片和視頻,不管是高寬比、長短、高清還是低清,都分割成了一小塊。研究人員可以根據輸入影片的大小,訓練模型認識不同數量的小塊,這也讓Sora能更靈活地學習各種數據,並產生不同解析度和尺寸的內容。

這項技術在Sora技術文件裡也有提過,就是所謂的patch。

大語言模型建模時把文字拆成了以token為最小單位,而影片大模型中的token就是patch。

這項技術並不是OpenAI創造的,當OpenAI宣布使用了該技術時還引起了討論,為什麼OpenAI能就能透過別人的技術造出好的AI產品出來。

主持又問:你覺得Sora擅長做什麼?哪些方面還有所欠缺?例如我看到有個影片裡一隻手竟然長了六根手指。

Sora團隊先揚後抑的表示到,Sora擅長寫實類視頻,並且可以生成1分鐘時長的視頻,很強。但仍存在一些問題,例如手部細節(所有AI的噩夢)攝影機軌跡、物理現象變化等。

除此之外,Sora團隊還介紹了一些其他酷炫的功能,例如透過除prompt之外,用影片合成的方式產生影片。這實現了在完全不同主題和場景構成的影片之間無縫過渡。

在OpenAI的Tiktok上就有無人機變成蝴蝶在鬥獸場轉化的珊瑚礁中飛翔的影片。

無論在技術或體驗上,都與原先的影片生成模型完全不同。 Aditya Ramesh更是表示,他們做的事情,就是先模擬自然,再超越自然!

目前為止,OpenAI在Tiktok上的AI生成影片都使用了配音,而不是AI無縫生成聲音。 Sora團隊表示,AI聲音暫時不是他們考慮的事情,當務之急還是在於影片生成,讓它實現更長的時間,更好的畫質和頻率。

但不知道隨著Pika Sound Effects功能的發布,Sora加上聲音是否指日可待。

被主持人問到,Sora下一步發展方向時。 Sora成員Tim Brooks表示,在真正發布之前,Sora還有兩方面的工作要完成:

首先是獲得更多用戶的回饋,了解Sora如何為人們帶來價值。例如有用戶希望對產生的影片有更多精細、直接的控制,而不單單是prompts。

另一方面,Sora安全工作需要加強,OpenAI會全面考慮可能帶來的各種影響。目前,正在訓練應用於影片的溯源分類器,實現識別影片是否由AI生成,並且為每個Sora生成的影片都打上了水印。

此外,Sora團隊表示,AI生成影片也帶來了許多機遇,它可以大幅降低從創意到成片的成本,一個人拍一部電影完全有可能實現。

更令他們興奮的是,隨著AI新工具的出現,會有人創造出全新的東西,不斷推進創造力的邊界,將不可能變成可能。

但打住,這只是科學家美好的幻想。畢竟對一般人來說,離真正使用上Sora都要等上撐長一段時間。

而且,Sora成員透露。 AI透過從影片資料中學習,將不僅僅在影片創作方面發揮作用。像GPT這樣的模型,雖然很聰明,但如果它們無法像我們一樣「看到」這個世界,那麼它們就會缺少一些資訊。類似Sora的模型正在解決這個問題。

這是證實AGI要來了嗎?

最後主持人問了一個有趣的問題,Sora產生一個影片要多久?

“取決於各種情況,但你可以離開,去喝杯咖啡,然後回來它還在處理中,反正就是很久。”

以上就是Sora團隊的訪談內容,簡單總結一下就是:Sora很厲害,可以看到世界,正因如此,我們還不能讓普通人很快就用到,還有很多安全工作要做。

Umm,沒活可以咬打火機,沒必要硬上的。